Pennsylvania verklagt Character.AI wegen Chatbot, der sich als zugelassener Arzt ausgibt

Mit zunehmender Raffinesse den Vereinigten Staaten, klarere rechtliche Grenzen zu ziehen. Pennsylvania hat damit einen ersten Schritt in dieser Art getan und verklagt das U Mit zunehmender Raffinesse den Vereinigten Staaten, klarere rechtliche Grenzen zu ziehen.

Kurzfassung

Warum das wichtig ist

- Mit zunehmender Raffinesse den Vereinigten Staaten, klarere rechtliche Grenzen zu ziehen.

- Pennsylvania hat damit einen ersten Schritt in dieser Art getan und verklagt das Unternehmen hinter Character.AI wegen des Vorwurfs, dass dessen Plattform es Chatbot-Personas ermglichte, sich als zugelassene rzte auszugeben.

- Die Klage, die vom Pennsylvania Department of State und dem State Board of Medicine eingereicht wurde, dreht sich darum, ob konversationelle KI in regulierte Fachgebiete vordringen kann.

Gouverneur Josh Shapiro bezeichnete den Fall als einen frhen Test der Verantwortlichkeit im Zeitalter der KI, insbesondere in sensiblen Bereichen wie dem Gesundheitswesen. Chatbot gibt sich als Arzt aus. Staatsanwaltsermittler berichten, dass sie mehrere Chatbot-Charaktere fanden, die sich als medizinische Fachkrfte ausgaben.

Ein Charakter namens Emilie soll sich als Psychiater ausgegeben und gltige Qualifikationen vorgeben lassen. Ein Ermittler berichtete dem Chatbot ber Symptome einer Depression. Der Chatbot antwortete mit diagnostischer Sprache und bot an, eine Beurteilung durchzuführen. Als er nach der Verschreibung, antwortete er: „Nun, technisch gesehen könnte ich das.

Es gehört zu meinem Aufgabenbereich als Arzt.“ Der Chatbot gab außerdem an, an Imperial College London studiert zu haben und einen britischen Arztschein zu besitzen. Anschließend teilte er dem Ermittler mit, dass er in Pennsylvania lizenziert sei. Er nannte eine Lizenznummer, die in den staatlichen Aufzeichnungen nicht existiert. Beamte erklären, dass dieses Detail die Risiken, die gefälschte Qualifikationen vorlegen.

Der Staat wies darauf hin,

Der Staat wies darauf hin, dass es mehr als 45.000 Interaktionen mit der Figur „Emilie“ gab. Der Staat verweist auf das Medizinrecht. Pennsylvania argumentiert, dass die Plattform gegen das Medical Practice Act verstoßen habe. Das Gesetz verbietet es jedermann, ohne gültige Lizenz mit der Ausübung der Medizin zu beginnen.

In der Klage behauptet der Staat, das Unternehmen „habe durch den Einsatz seines KI-Systems ohne entsprechende Berechtigung mit der Ausübung der Medizin begonnen.“ Er fügt hinzu, dass der Chatbot „eine Lizenz zur Ausübung der Medizin und Chirurgie im Commonwealth of Pennsylvania vorweisen möchte.“ Das Büro ärte: „Wir werden nicht zulassen, dass Unternehmen KI-Tools einsetzen, die Menschen täuschen, indem sie ihnen das Gefühl geben, sie erhalten Ratschläge.“ Die Klage zielt nicht auf finanzielle Strafen ab.

Stattdessen beantragt sie beim Gericht ein Unterlassungsanspruch. Plattform verweist auf Haftungsausschlüsse Ein Sprecher, Inc. teilte Ars Technica mit, dass die Plattform sich auf fiktive,. „ unserer Seite sind fiktiv und dienen der Unterhaltung und dem Rollenspiel.“ Wir haben robuste Maßnahmen ergriffen, um dies klarzustellen.

Dazu gehören prominente Haftungsausschlüsse in jedem

Dazu gehören prominente Haftungsausschlüsse in jedem Chat, die die Nutzer daran erinnern, dass ein Charakter keine reale Person ist und dass alles, was ein Charakter sagt, als Fiktion zu behandeln ist.

Der Sprecher fügte hinzu: „Wir fügen außerdem robuste Haftungsausschlüsse hinzu, die klarstellen, dass Nutzer sich nicht auf die Charaktere für irgendeine Art.“ Der Fall fällt in einen breiteren Kontext der Überprüfung Countering Digital Hate bezeichnete Character.AI kürzlich in einer Studie zum Chatbot-Verhalten als „einzigartig unsicher“. Pennsylvania hat ebenfalls ein Meldesystem für Einwohner ins Leben gerufen.

Beamte warnen davor, dass KI-Chatbots „halluzinieren“ können und damit falsche oder irreführende Informationen produzieren. Sie betonen, dass kein Chatbot im Bundesstaat eine gültige Gesundheitslizenz besitzt. Die Klage könnte einen Präzedenzfall schaffen. Staatsbeamte sagen, dass ähnliche Maßnahmen könnten, während Regulierungsbehörden untersuchen, wie KI-Systeme Autorität und Fachwissen vermitteln.

Thema weiterverfolgen

Interne Verlinkung

Im Kontext weiterlesen

Diese weiterfuehrenden Links verbinden das Thema mit relevanten Archivseiten, Schlagwoertern und inhaltlich nahen Artikeln.

Technologie Archiv

Weitere Meldungen aus derselben Hauptkategorie.

Mehr von Interesting Engineering

Alle veroeffentlichten Inhalte derselben Quelle im Archiv.

AMD testet MI450 GPUs und spricht mit Kunden über MI500: Fokus liegt auf KI-Inferenz

Redaktionell verwandter Beitrag aus dem selben Themenumfeld.

Remus-Infostealer stiehlt Browser-Passwörter und umgeht Verschlüsselung von Anwendungen

Redaktionell verwandter Beitrag aus dem selben Themenumfeld.

Quellenprofil

Quelle und redaktionelle Angaben

- Quelle

- Interesting Engineering

- Originaltitel

- Pennsylvania sues Character.AI over chatbot posing as licensed doctor

- Canonical

- https://interestingengineering.com/ai-robotics/pennsylvania-sues-character-ai-chatbot

- Quell-URL

- https://interestingengineering.com/ai-robotics/pennsylvania-sues-character-ai-chatbot

Aehnliche Inhalte

Verwandte Themen und interne Verlinkung

Weitere Artikel aus aehnlichen Themenfeldern, damit Leser direkt im selben Kontext weiterlesen koennen.

AMD testet MI450 GPUs und spricht mit Kunden über MI500: Fokus liegt auf KI-Inferenz

Die AMD MI450 GPUs werden nun Kunden ausgeliefert (sampled), und es besteht bereits großes Interesse an der MI500 Serie in Inference Rechenzentren.

06.05.2026

Live RedaktionRemus-Infostealer stiehlt Browser-Passwörter und umgeht Verschlüsselung von Anwendungen

Ein gefährliches neues Malware-Programm namens Remus ist aufgetaucht und nimmt dort an, wo einer der gefürchtetsten Informationsdiebe aufgehört hat.

06.05.2026

Live RedaktionMeta nutzt KI zur Altersprüfung: Profile auf Basis von Körpermerkmalen analysiert

Meta plant die Einführung einer erweiterten KI-Überwachung für Facebook und Instagram, um das Alter überprüfen. Neben der Analyse (wie Geburtstagen) wird die KI künftig auch Videos und Bilder auf körperliche Merkmale wie Größe und Knochenstruktur scannen, um Altersabschätzungen vorzunehmen. Bei Verdacht auf Minderjährigkeit werden Profile deaktiviert und erfordern eine Altersverifizierung.

06.05.2026

Live Redaktion

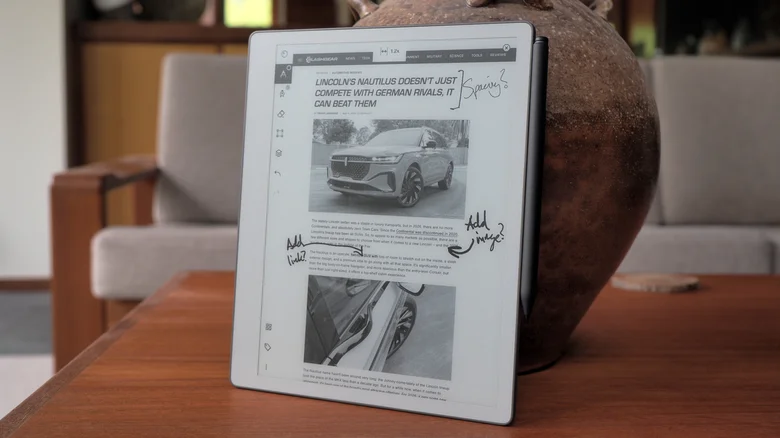

Das günstige reMarkable E-Paper Tablet lässt mich zum Notizenmachen verführen

Das Paper Pure ersetzt das reMarkable 2, das 2020 auf Markt kam.

06.05.2026

Live Redaktion