PCIe KI-Beschleuniger mit 384 GB RAM: 700-Billionen-LLMs lokal bei nur 240 Watt, weniger als die Hälfte des RTX PRO 6000 Blackwell

Ein taiwanesisches Unternehmen hat seine neue PCIe-KI-Beschleunigerkarte vorgestellt, die 700 Milliarden Parameter große Sprachmodelle (LLMs) lokal mit nur 240 Watt Leistungsbedarf betreiben kann und damit Bedarf

Kurzfassung

Warum das wichtig ist

- Ein taiwanesisches Unternehmen hat seine neue PCIe-KI-Beschleunigerkarte vorgestellt, die 700 Milliarden Parameter große Sprachmodelle (LLMs) lokal mit nur 240 Watt Leistungsbedarf betreiben kann und damit Bedarf

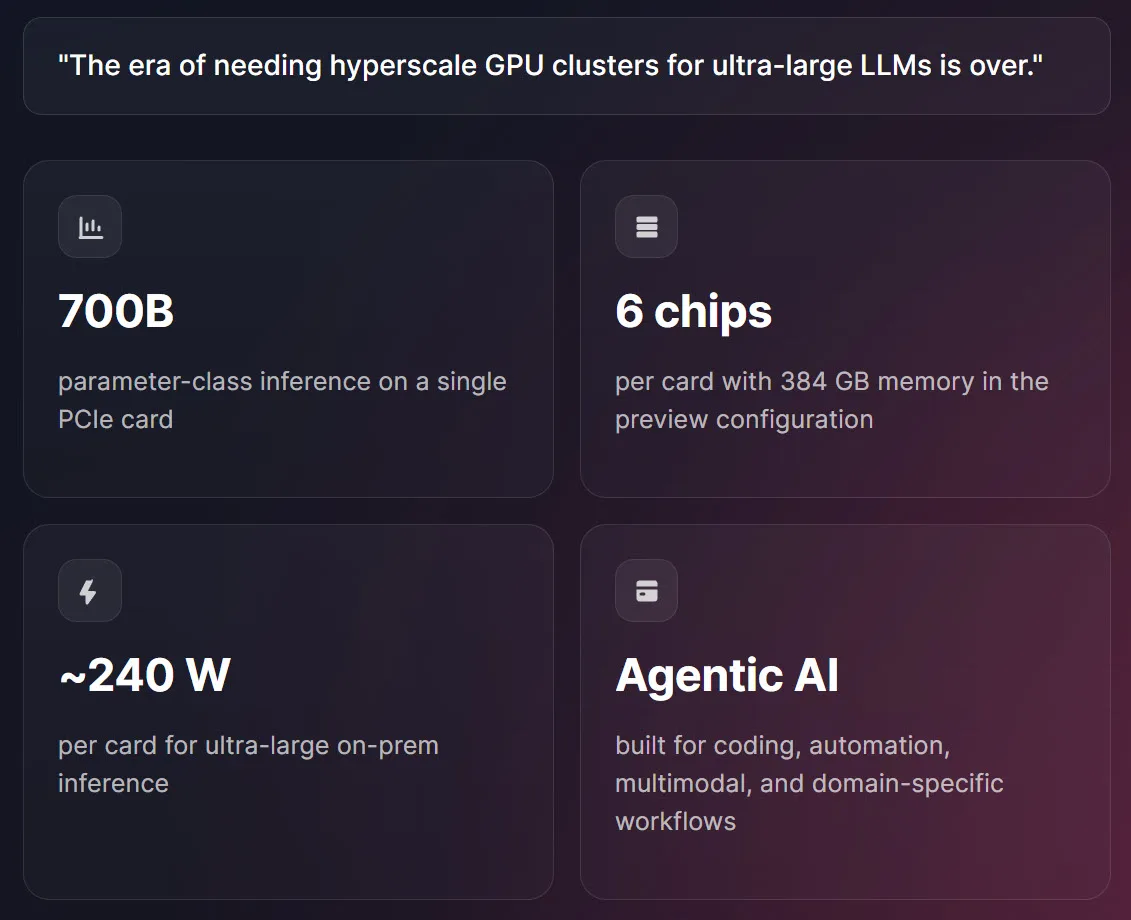

- Skymizer, ein in Taiwan ansässiges Unternehmen, das sich auf KI-Software und -Hardware spezialisiert hat, hat seine brandneue Lösung HTX301 angekündigt.

- Die HTX301 ist für On-Premise-KI konzipiert, bietet ein PCIe-Add-in-Card-Design und liefert KI-Leistung auf Großskalenniveau bei einem TDP unter 250 Watt.

Zu den Highlights der Karte gehören: Das Unternehmen gibt an, dass der HTX301 PCIe-KI-Beschleuniger sein erster Inferenz-Chip ist, der auf der HyperThought-Plattform basiert und dessen nächste Generation LPU-IP (Logic Processing Unit Intellectual Property) integriert. Die Plattform wurde speziell für LLMs entwickelt und optimiert Leistung sowie Energieeffizienz.

Die HTX301 sieht aus wie eine Standard-PCIe-Karte und verfügt über einen einzelnen Chip, um den herum das Speichermodul angeordnet ist. Das Unternehmen erklärt, dass jedes Board sechs HTX301-Chips enthält und trotz des Einsatzes eines älteren 28-nm-Prozesses außergewöhnliche Ergebnisse liefert, wie beispielsweise die Erzielung von 30 Tokens pro Sekunde bei lediglich 0,5 TOPS und einer Bandbreite von 100 GB/s.

Die LPU ist zudem hochgradig skalierbar und ermöglicht dadurch verschiedene Designoptionen. Die Octa-Core-LPU erreicht bei der Prefill von Llama2 7B 240 Tokens pro Sekunde; das Unternehmen kann mehrere Chips miteinander verbinden, um im selben LLM bis zu 1.200 Tokens pro Sekunde zu erzielen, wobei zusätzliche Unterstützung für Modelle mit bis zu 700 Milliarden Parametern vorgesehen ist.

Die PCIe-Karte verfügt über bis

Die PCIe-Karte verfügt über bis zu 384 GB Arbeitsspeicher. Sie nutzt standardmäßige LPDDR4- und LPDDR5-DRAMs, sodass keine aufwendigen Lösungen wie LP5X, HBM oder GDDR6/7 erforderlich sind. Das Design wurde für geringere Parameteranzahlen und niedrigere Anforderungen an die DRAM-Bandbreite ausgewählt. Die Architektur des Skymizer HTX301 setzt zudem auf effiziente Komprimierungstechniken.

Ein weiterer Highlight ist der Energieverbrauch: Der Chip benötigt lediglich 240 Watt, also weniger als die Hälfte der 600 Watt, die führende PCIe-AI-Beschleuniger wie die NVIDIA RTX PRO 6000 Blackwell und der AMD Instinct MI350P verbrauchen.

Skymizer verspricht beeindruckende Werte und wird den HTX301 auf der diesjährigen Computex vorstellen; wir werden das Stand des Unternehmens definitiv besuchen, um zu prüfen, ob die Angaben haltbar sind.

Insgesamt klingt dies auf den ersten

Insgesamt klingt dies auf den ersten Blick wie eine beeindruckende KI-Lösung, die dazu anregen könnte, dass mittelständische Unternehmen bei ihren KI-Anforderungen weiterhin auf lokale Server setzen, statt in die Cloud zu investieren. Über den Autor: Hassan Mujtaba ist PC-Enthusiast; er fungiert als Senior-Editor für den Hardware-Bereich bei Wccftech.

Mit jahrelanger Branchenerfahrung spezialisiert er sich auf tiefgehende technische Analysen nächsten Generation für CPUs und GPUs, Mainboards sowie Kühlsystemen. Seine Arbeit umfasst nicht nur die Berichterstattung über aktuelle Neuigkeiten zu kommenden Technologien, sondern auch umfangreiche praktische Tests und Benchmarks. Sie Wccftech auf Google, um weitere unserer Nachrichtenberichterstattung in Ihren Feeds zu erhalten.

Quelllink

Wccftech - Originalartikel oeffnenThema weiterverfolgen

Interne Verlinkung

Im Kontext weiterlesen

Diese weiterfuehrenden Links verbinden das Thema mit relevanten Archivseiten, Schlagwoertern und inhaltlich nahen Artikeln.

Technologie Archiv

Weitere Meldungen aus derselben Hauptkategorie.

Mehr von Wccftech

Alle veroeffentlichten Inhalte derselben Quelle im Archiv.

Neuronale Abkürzung als Schlüssel zur Sprachverarbeitung

Redaktionell verwandter Beitrag aus dem selben Themenumfeld.

Crimson Desert lehnt Silicon-Valley-Ego ab und setzt auf Community-Ideen statt auf starre Roadmaps

Redaktionell verwandter Beitrag aus dem selben Themenumfeld.

Quellenprofil

Quelle und redaktionelle Angaben

- Quelle

- Wccftech

- Originaltitel

- This PCIe AI Accelerator Card Can Run 700B LLMs Locally With 384 GB Memory at Just 240W, Less Than Half The Power of RTX PRO 6000 Blackwell

- Canonical

- https://wccftech.com/this-pcie-ai-accelerator-card-packs-384-gb-memory-run-700b-llms-240w/

- Quell-URL

- https://wccftech.com/this-pcie-ai-accelerator-card-packs-384-gb-memory-run-700b-llms-240w/

Aehnliche Inhalte

Verwandte Themen und interne Verlinkung

Weitere Artikel aus aehnlichen Themenfeldern, damit Leser direkt im selben Kontext weiterlesen koennen.

Neuronale Abkürzung als Schlüssel zur Sprachverarbeitung

Zusammenfassung: Sprache wird häufig als gewaltiger Sprung in Gehirnkomplexität betrachtet, doch neue Forschungsergebnisse deuten darauf hin, dass sich komplexe vokale Ausdrucksformen möglicherweise viel einfacher

07.05.2026

Live Redaktion

Crimson Desert lehnt Silicon-Valley-Ego ab und setzt auf Community-Ideen statt auf starre Roadmaps

Crimson Desert erhält herausragende Nachlaunch-Unterstützung.

07.05.2026

Live Redaktion

Gen-Therapie ermöglicht Gehfähigkeit nach Lähmung

Forscher haben einen Designer-Zytokin, hIL-6, eingesetzt, um das Rückenmark umzuprogrammieren, indem sie Austreiben neuer Verbindungen Ansatz konnte die koordinierte For

07.05.2026

Live Redaktion

Capcom schneidet Resident Evil Requiem: Datamine enthüllt Ermittlungsmechanik und tiefere Leon-Grace-Interaktion

In Bezug auf Umfang unterscheidet sich Resident Evil Requiem nicht wesentlich ängern, doch scheint es, als hätte CAPCOM während Entwicklung Ambitionen Spiels zurückgefahren.

07.05.2026

Live Redaktion