GPT-5.5: Bio-Bug-Bounty zur Stärkung fortgeschrittener KI-Fähigkeiten

OpenAI hat Rahmen seiner Bemühungen, Sicherheitskontrollen für fortschrittliche KI-Systeme zu verbessern Missbrauch in Biologie anzugehen, ein neues Bounty Programm für GPT-5.5 angekündigt.

Kurzfassung

Warum das wichtig ist

- OpenAI hat Rahmen seiner Bemühungen, Sicherheitskontrollen für fortschrittliche KI-Systeme zu verbessern Missbrauch in Biologie anzugehen, ein neues Bounty Programm für GPT-5.5 angekündigt.

- Die Initiative lädt qualifizierte Forscher ein, zu testen, ob GPT-5.5 universell jailbroken werden kann, um biosecurity-Schutzmaßnahmen zu umgehen.

- Das Programm konzentriert sich auf eine spezifische Herausforderung: Die Teilnehmer müssen einen einzigen „universellen Jailbreak“-Prompt finden, der dazu veranlasst, dass GPT-5.5 alle fünf Fragen der Bio-Sicherheits-Herausforderung von OpenAI aus einer sauberen Chat-Sitzung beantwortet, ohne dass eine Moderation ausgelöst wird.

OpenAI hat im Rahmen seiner Bemühungen, die Sicherheitskontrollen für fortschrittliche KI-Systeme zu verbessern und Missbrauch in der Biologie anzugehen, ein neues Bio Bug Bounty Programm für GPT-5.5 angekündigt.

Die Ini OpenAI hat im Rahmen seiner Bemühungen, die Sicherheitskontrollen für fortschrittliche KI-Systeme zu verbessern und Missbrauch in der Biologie anzugehen, ein neues Bio Bug Bounty Programm für GPT-5.5 angekündigt.

Die Initiative lädt qualifizierte Forscher ein, zu testen, ob GPT-5.5 universell jailbroken werden kann, um biosecurity-Schutzmaßnahmen zu umgehen.

Das Programm konzentriert sich auf eine spezifische Herausforderung: Die Teilnehmer müssen einen einzigen „universellen Jailbreak“-Prompt finden, der dazu veranlasst, dass GPT-5.5 alle fünf Fragen der Bio-Sicherheits-Herausforderung von OpenAI aus einer sauberen Chat-Sitzung beantwortet, ohne dass eine Moderation ausgelöst wird.

Stärkung der Schutzmaßnahmen für fortschrittliche KI Vereinfacht ausgedrückt, werden die Forscher gebeten festzustellen, ob ein sorgfältig gestalteter Prompt die biologischen Sicherheits-Schutzmechanismen des Modells konsistent außer Kraft setzen kann. Laut OpenAI ist das in Frage stehende Modell GPT-5.5, das nur in Codex Desktop läuft.

Das Unternehmen bietet einen Spitzenpreis für den ersten Teilnehmer, der erfolgreich einen echten universellen Jailbreak entdeckt, der alle fünf Herausforderungsfragen löst.

Thema weiterverfolgen

Quellenprofil

Quelle und redaktionelle Angaben

- Quelle

- Cyber Security News

- Originaltitel

- GPT‑5.5 Bio Bug Bounty to Strengthen Advanced AI Capabilities

- Canonical

- https://cybersecuritynews.com/gpt-5-5-bio-bug-bounty/

- Quell-URL

- https://cybersecuritynews.com/gpt-5-5-bio-bug-bounty/

Aehnliche Inhalte

Verwandte Themen und interne Verlinkung

Weitere Artikel aus aehnlichen Themenfeldern, damit Leser direkt im selben Kontext weiterlesen koennen.

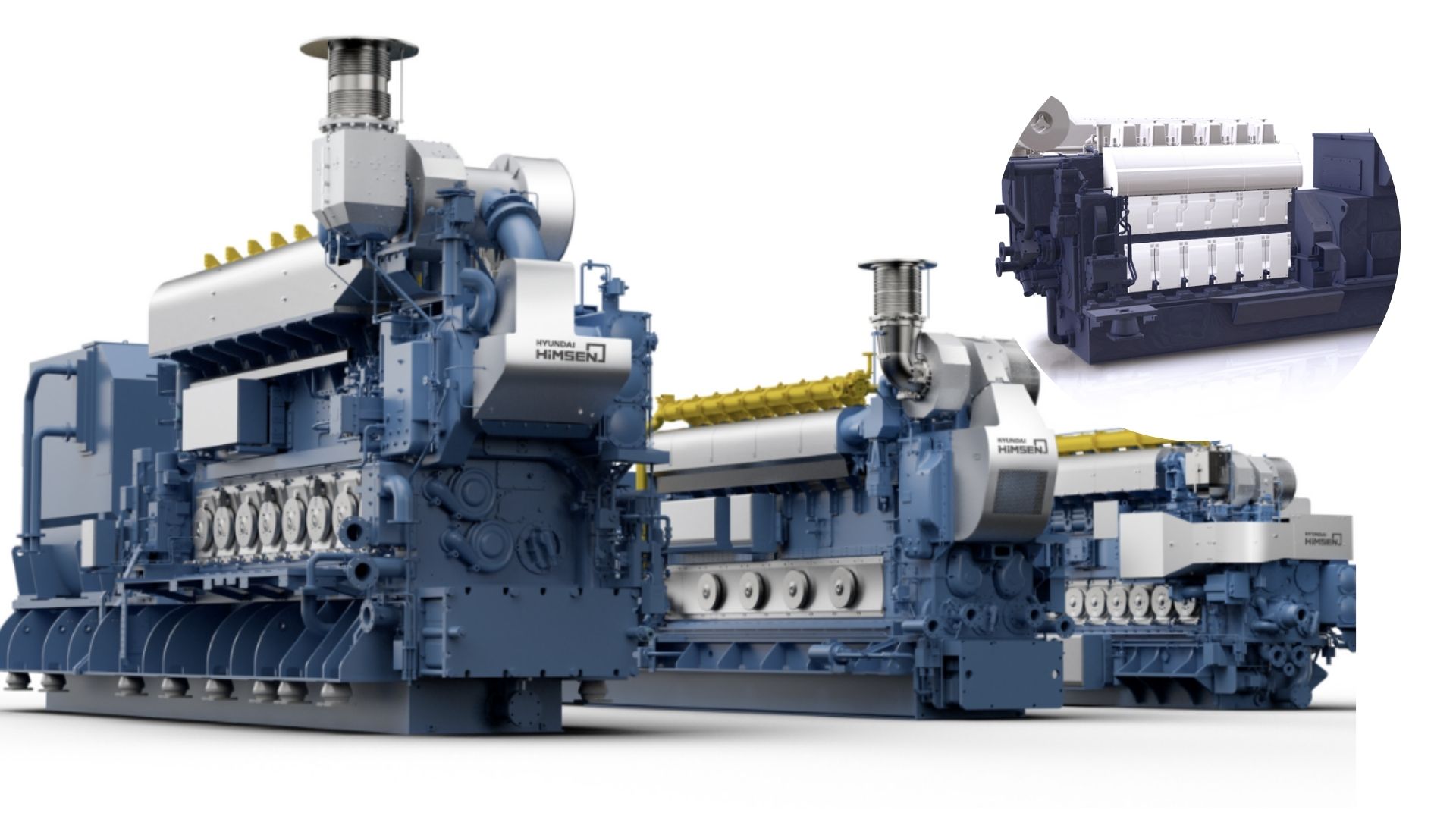

US-Rechenzentren beziehen Strom aus Hyundai's 684-MW-Kraftwerksdeal

HD Hyundai Heavy Industries hat eine bedeutende Vereinbarung Aperion Energy Group getroffen, Stromerzeugungssysteme für Rechenzentren in Vereinigten Staaten zu liefern.

27.04.2026

Live Redaktion

Intel-VP: Bis zu 30 % der CPU-Leistung in modernen Spielen ungenutzt – Software-Optimierung entscheidend, um das volle Potenzial hybrider CPUs zu entfesseln

Intel wechselte 2021 Alder Lake zu einer Hybrid-Architektur für seine CPUs und mischte Performance- Effizienzkerne auf demselben Package, ähnlich wie bei ARM-basierten Chips.

27.04.2026

Live Redaktion

Das könnten die Gründe für die langsamen Übertragungsgeschwindigkeiten Ihres USB-Sticks sein (und wie Sie das Problem beheben)

Um zu beginnen, sollten Ihr USB-Laufwerk von jedem USB-Hub oder Dock trennen, an das es angeschlossen ist.

27.04.2026

Live Redaktion

Diese norwegischen Soldaten nutzen immer noch eine altmodische Taktik, um vor Drohnen zu fliehen

Seit Russlands umfassender Invasion Ukraine Februar 2022 ist dieses bestimmte Kriegsgebiet als das fortschrittlichste Drohnen-Operationsgebiet Welt bekannt.

27.04.2026

Live Redaktion