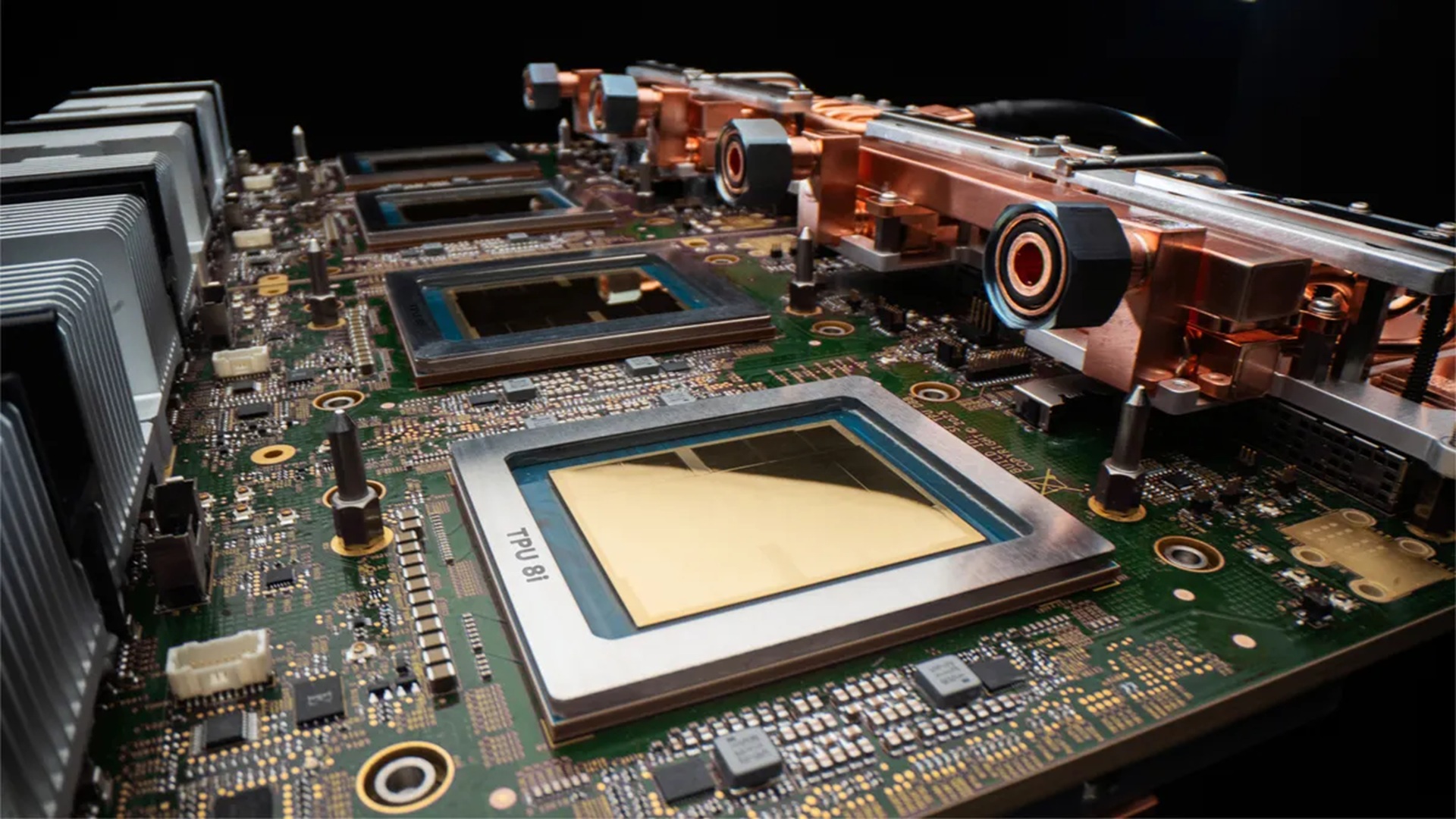

Google bringt TPU 8 Chips auf den Markt, um das Training von KI zu beschleunigen und Kosten zu senken

Google hat seine Tensor Processing Units der achten Generation vorgestellt und zwei kundenspezifische KI-Chips eingeführt, die separat für das Modelltraining und die Inferenz entwickelt wurden, da die Nachfrage nach groß

Google hat seine Tensor Processing Units der achten Generation vorgestellt und zwei kundenspezifische KI-Chips eingeführt, die separat für das Modelltraining und die Inferenz entwickelt wurden, da die Nachfrage nach groß Google hat seine Tensor Processing Units der achten Generation vorgestellt und zwei kundenspezifische KI-Chips eingeführt, die separat für das Modelltraining und die Inferenz entwickelt wurden, da die Nachfrage nach groß angelegter KI-Rechenleistung steigt.

Die neuen Prozessoren, genannt TPU 8t und TPU 8i, wurden auf Google Cloud Next angekündigt.

Sie sollen die KI Hypercomputer-Plattform von Google antreiben und Workloads unterstützen, die von der Schulung von Frontier-Modellen bis zum Betrieb von KI-Agenten in der Produktion reichen.

TPUs sind Googles interne Beschleuniger, die

TPUs sind Googles interne Beschleuniger, die seit Jahren interne Systeme wie Gemini mit Strom versorgen.

Das Unternehmen erweitert diese Hardware nun für Kunden, die Alternativen zur von Nvidia dominierten KI-Infrastruktur suchen.

Google gab bekannt, dass beide Chips später in diesem Jahr allgemein verfügbar sein werden. Zwei Chips kommen heraus Der TPU 8t ist für das Training großer KI-Modelle optimiert.

Leistung und Energieausbeute

Google sagte, ein einzelner Superpod kann auf 9.600 Chips skaliert werden und liefert 121 Exaflops Rechenleistung. Das Unternehmen fügte hinzu, dass TPU 8t nahezu dreimal so hohe Rechenleistung pro Pod im Vergleich zur vorherigen Generation, Ironwood, bietet.

Auch Trainingssysteme erhielten einen schnelleren Speicherkennzugriff und ein verbessertes Netzwerk, das darauf abzielt, die Chips mit Arbeit zu beschäftigen, anstatt sie warten zu lassen, bis Daten verfügbar sind.

Google sagte, dass TPU 8t mehr als 97 Prozent „Goodput“ anstrebt, ein Begriff, der verwendet wird, um die produktive Rechenzeit anstelle der durch Ausfälle oder Engpässe verursachten Leerlaufzeit zu messen. Das ist wichtig, weil Verzögerungen in riesigen Clustern die Trainingspläne für fortschrittliche KI-Systeme um Tage verlängern können.

Das TPU 8i konzentriert sich auf

Das TPU 8i konzentriert sich auf die Inferenz, die Phase, in der trainierte KI-Modelle Anfragen beantworten, Tools ausführen und Software-Agenten betreiben.

Agenten-�ra-SchubGoogle sagte, dass TPU 8i 288 GB Hochbandbreiten-Speicher und 384 MB On-Chip-SRAM enth�lt, was hilft, aktive Modelldaten n�her am Prozessor zu halten, um schnellere Antworten zu gew�hrleisten. Der Chip verwendet außerdem Googles Axion Arm-basierte CPUs und eine verbesserte Interconnect-Bandbreite für Mixture of Experts, oder MoE, Modelle.

Diese Architekturen aktivieren nur Teile eines Modells gleichzeitig, um Kosten zu senken und gleichzeitig die Leistung zu skalieren. Laut Google liefert der TPU 8i eine um 80 % bessere Leistung pro Dollar als die vorherige Generation, was es Kunden ermöglicht, bei gleichen Kosten fast doppelt so viel Arbeitslast zu bewältigen.

Die Einführung unterstreicht, wie die KI-Infrastruktur

Die Einführung unterstreicht, wie die KI-Infrastruktur über allgemeine GPUs hinausgeht und sich hin zu spezialisierten Chips entwickelt, die für verschiedene Arbeitslasten abgestimmt sind.

Google erklärte, dass die Zwei-Chip-Strategie durch den Aufstieg von KI-Agenten geformt wurde, die Systeme benötigen, die Aufgaben durchdenken, Workflows ausführen und wiederholt mit Tools und anderen Modellen interagieren können. In Rechenzentren berichtete Google, dass beide Chips außerdem eine bis zu doppelt bessere Leistung pro Watt als Ironwood bieten.

Sie verwenden vierteilige Flüssigkeitskühlung, um eine höhere Rechendichte zu unterstützen und gleichzeitig den Stromverbrauch zu kontrollieren.

Die Ankündigung unterstreicht auch Googles breiteren

Die Ankündigung unterstreicht auch Googles breiteren Versuch, Nvidias Griff auf die KI-Hardware zu herausfordern, indem es benutzerdefinierte Siliziumbausteine, Networking, Software-Frameworks und Cloud-Dienste in einem Stack kombiniert. Sowohl TPU 8t als auch TPU 8i werden später in diesem Jahr über Google Cloud verfügbar sein.

Google sagte, die Chips unterstützen auch Frameworks wie JAX, PyTorch, SGLang und vLLM und ermöglichen es Entwicklern, bestehende KI-Workloads ohne größere Software-Neuschreibungen oder Migrationshürden auszuführen.

Interne Verlinkungen

Quellenprofil

Quelle und redaktionelle Angaben

- Quelle

- Interesting Engineering

- Originaltitel

- Google launches TPU 8 chips to speed AI training and cut costs

- Canonical

- https://interestingengineering.com/ai-robotics/google-tpu-8t-8i-ai-chips-launch

- Quell-URL

- https://interestingengineering.com/ai-robotics/google-tpu-8t-8i-ai-chips-launch

Aehnliche Inhalte

Verwandte Themen und interne Verlinkung

Intelligentes Kissen warnt gehörlose Nutzer nachts vor Brand- und Einbruchalarmen

Menschen, die taub sind, verpassen oft kritische Alarme während des Schlafs, wodurch ernsthafte Sicherheitsrisiken entstehen.

25.04.2026

Live Redaktion

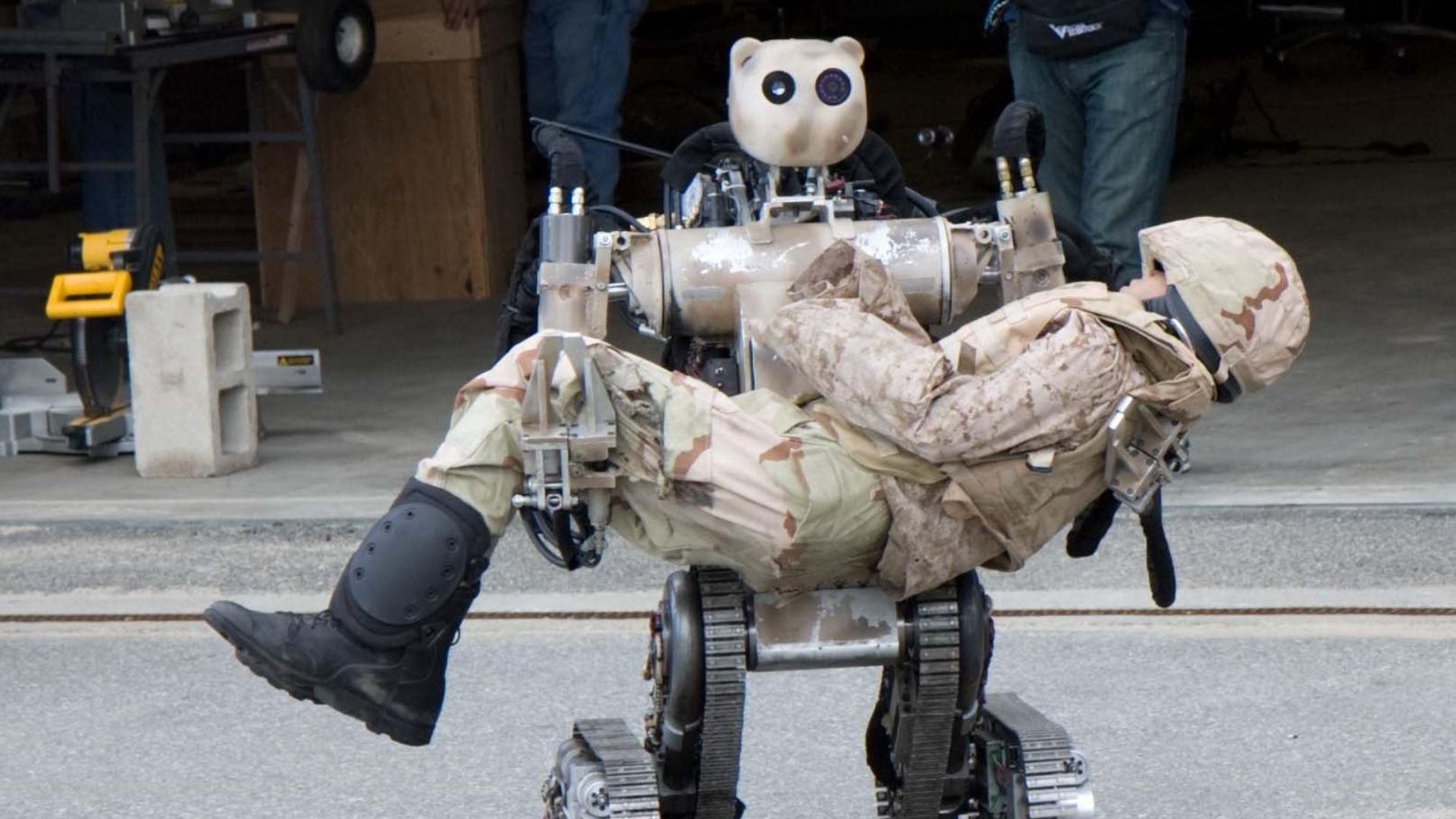

US Army sucht Roboter für Nachschub und Evakuierung von Verwundeten an vorderster Front

Die U.S. Army drängt darauf, Soldaten bei einigen der gefährlichsten Gefechtsaufgaben durch Roboter zu ersetzen: das Verlegen von Nachschub und die Evakuierung verwundeter Truppen nahe der Frontlinien.

25.04.2026

Live Redaktion

Bösartige Google Ads zielen auf Krypto-Nutzer ab und stehlen über Wallet-Drainer und Seed-Phrasen Daten

Cyberkriminelle nutzen nun Googles eigene Werbeplattform, um Kryptowährungen von ahnungslosen Nutzern zu stehlen.

25.04.2026

Live Redaktion.webp)

109 gefälschte GitHub-Repositories zur Verbreitung von SmartLoader und StealC Malware

Eine groß angelegte Malware-Verbreitkampagne wurde aufgedeckt, bei der 109 gefälschte GitHub-Repositories beteiligt waren, die dazu dienten, Benutzer dazu zu verleiten, zwei gefährliche Malware-Tools namens SmartLoader u

25.04.2026

Live Redaktion