AMD vLLM-ATOM-Plugin beschleunigt DeepSeek-R1, Kimi-K2 und gpt-oss-120B auf Instinct MI350/MI400

AMD hat einen neuen Plugin namens vLLM-ATOM vorgestellt, der AI-LLMs beschleunigt und dabei Instinct-MI350- und MI400-GPUs untersttzt.

Kurzfassung

Warum das wichtig ist

- AMD hat einen neuen Plugin namens vLLM-ATOM vorgestellt, der AI-LLMs beschleunigt und dabei Instinct-MI350- und MI400-GPUs untersttzt.

- Das vLLM-ATOM ist ein speziell entwickeltes Plugin, das darauf abzielt, die Inferenzleistung bei verschiedenen AI-LLMs zu verbessern.

- Es ist um AMDs High-Performance-Instinct-GPU-Beschleuniger wie die MI350- und MI400-Serie herum konzipiert und kann sowohl als eigenstndiger Inferenzserver als auch durch nahtlose Integration als Plugin-Backend betrieben werden.

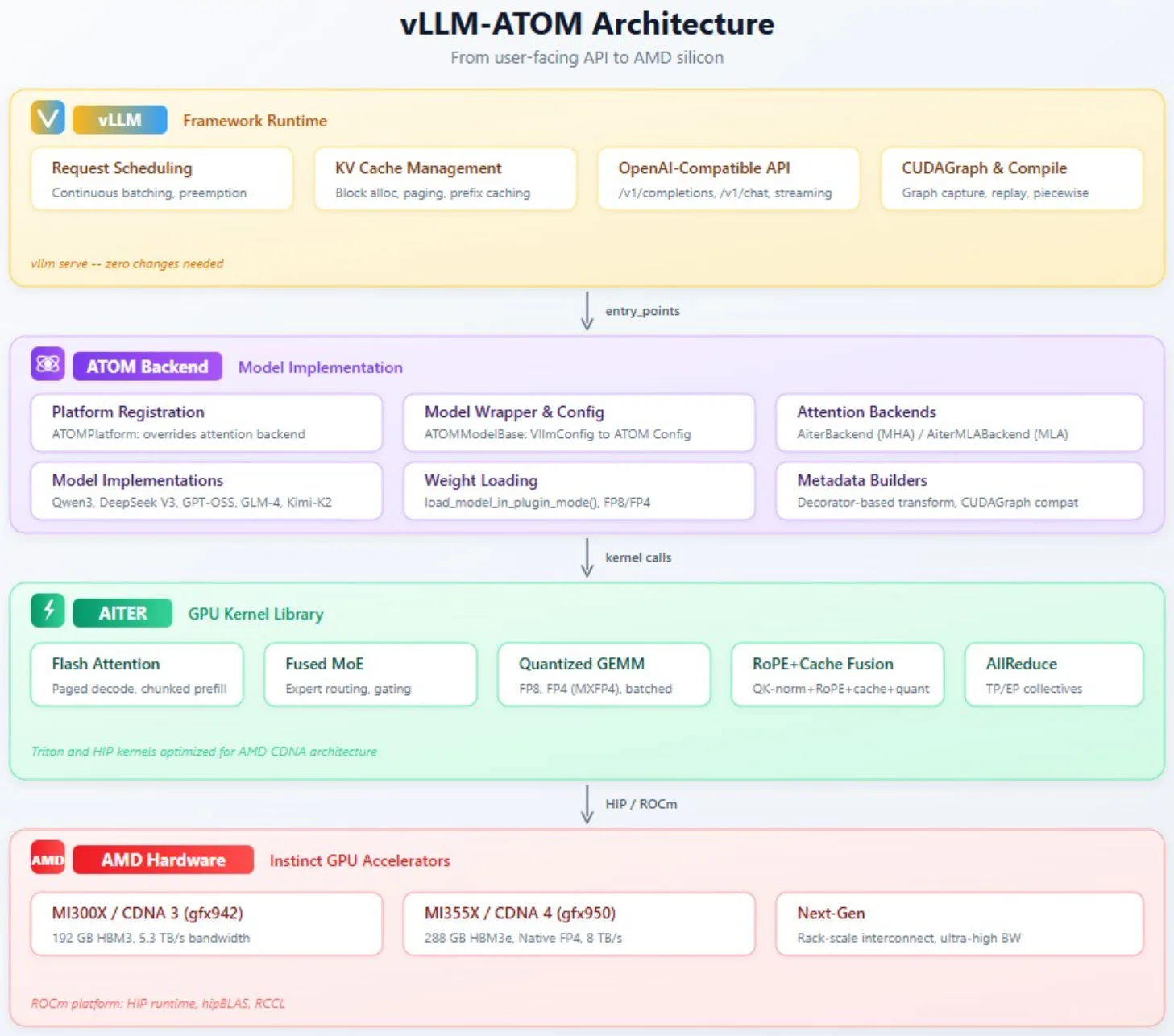

Dadurch knnen Nutzer die vollen Vorteile der nativen Modell- und Kernel-Optimierungen, ohne nderungen am Kern. Zu den Hauptmerkmalen: Die Architektur drei Ebenen: Hinsichtlich der Modelluntersttzung untersttzt das vLLM-ATOM-Plugin sowohl AI-LLMs als auch VLMs ber eine einheitliche Serving-Pipeline.

Im Folgenden finden Sie die vollstndige Liste: Hinweis: vLLM-ATOM beweist, dass hardware-spezifische Optimierungen und Framework-Kompatibilitt nicht unvereinbar sind.

Durch die Nutzung des vLLM-Plugin-Mechanismus aus der Box heraus bietet ATOM native Kernel-Optimierungen für AMD, darunter fused attention, quantisierte GEMM und optimiertes MoE-Routing, während es das gesamte Funktionsset, auf das produktionsreife LLM-Bereitstellungen angewiesen sind.

Über die unmittelbaren Leistungssteigerungen hinaus dient die Architektur des Plugins als entscheidende Testumgebung für Hard- und Software-Innovationen: Optimierungen, die im Plugin-Modus, werden schrittweise in den nativen ROCm-Backend übernommen und kommen der gesamten ROCm- sowie Open-Source-LLM-Community zugute.

Für Endnutzer bedeutet dies den sofortigen Zugriff auf die neuesten Hardware-Fähigkeiten, ohne auf langsame Integrationszyklen für die Weitergabe warten zu müssen – ein sich selbst verstärkender Kreislauf der Co-Evolution zwischen Hardware-Innovationen -Ökosystem. Über den Autor: Hassan Mujtaba ist Software-Engineer Leidenschaft und fungiert als Senior Editor für den Hardware-Bereich bei Wccftech.

Mit jahrelanger Erfahrung in der Branche konzentriert er sich auf tiefgehende technische Analysen, Mainboards sowie Kühlsystemen. Seine Arbeit umfasst nicht nur die Berichterstattung über Neuigkeiten zu kommenden Technologien, sondern auch umfangreiche praktische Tests und Benchmarks. Sie Wccftech auf Google, um weitere unserer Nachrichtenabdeckungen in Ihren Feeds zu erhalten.

Quelllink

Wccftech - Originalartikel oeffnenThema weiterverfolgen

Interne Verlinkung

Im Kontext weiterlesen

Diese weiterfuehrenden Links verbinden das Thema mit relevanten Archivseiten, Schlagwoertern und inhaltlich nahen Artikeln.

Technologie Archiv

Weitere Meldungen aus derselben Hauptkategorie.

Mehr von Wccftech

Alle veroeffentlichten Inhalte derselben Quelle im Archiv.

Wasserstoffmotor mit Rekorderfolg: Diesel-Rival ohne Emissionen

Redaktionell verwandter Beitrag aus dem selben Themenumfeld.

Galaxy S26 Ultra: 512GB-Variante jetzt 222 Dollar günstiger auf Amazon

Redaktionell verwandter Beitrag aus dem selben Themenumfeld.

Quellenprofil

Quelle und redaktionelle Angaben

- Quelle

- Wccftech

- Originaltitel

- AMD’s vLLM-ATOM Plugin Supercharges DeepSeek-R1, Kimi-K2, and gpt-oss-120B AI LLM Inference on Instinct MI350 and MI400 Accelerators

- Canonical

- https://wccftech.com/amd-vllm-atom-plugin-supercharges-deepseek-r1-kimi-k2-gpt-oss-120b-ai-llm-inference-on-instinct-mi350-mi400/

- Quell-URL

- https://wccftech.com/amd-vllm-atom-plugin-supercharges-deepseek-r1-kimi-k2-gpt-oss-120b-ai-llm-inference-on-instinct-mi350-mi400/

Aehnliche Inhalte

Verwandte Themen und interne Verlinkung

Weitere Artikel aus aehnlichen Themenfeldern, damit Leser direkt im selben Kontext weiterlesen koennen.

Wasserstoffmotor mit Rekorderfolg: Diesel-Rival ohne Emissionen

Das Forschungsteam Otto-von-Guericke-Universität Magdeburg gibt an, dass sein Wasserstoffmotor bereits Wirkungsgrade von über 60 Prozent erreicht hat.

11.05.2026

Live Redaktion

Galaxy S26 Ultra: 512GB-Variante jetzt 222 Dollar günstiger auf Amazon

Das Galaxy S26 Ultra verfügt möglicherweise nicht über die größte Batteriekapazität, nicht über jene ultrasensitiven Sensoren oder eine leistungsstarke aktive Kühlsystem mit einem lautem Lüfter, doch es bietet eine Kombi

11.05.2026

Live RedaktionStar Fox 64 Remake: Alles, was über das Nintendo-Projekt 2026 bekannt ist

Nach fast einem Jahrzehnt Stille kehrt eine der beliebtesten Franchises ück.

11.05.2026

Live RedaktionUebersicht: Unbemanntes 19,8-Tonnen-UUV feuert Drohnen, Raketen und Torpedos unter Wasser ab

Ein türkisches Rüstungsunternehmen hat kürzlich ein neues, streikfähiges extra-großes unbemanntes Unterwasserfahrzeug vorgestellt, Drohnen, Raketen, Torpedos Minenkriegsladungen einsetzen kann, Bedrohungen

11.05.2026

Live Redaktion