OpenAI mobilisiert gesamte Chip-Industrie für KI-Training: AMD, NVIDIA, Intel, Microsoft und Broadcom setzen auf MRC

Es ist das eine, mit einem oder zwei großen Namen im KI-Segment zusammenzuarbeiten; OpenAI hat jedoch AMD, NVIDIA, Intel, Microsoft Broadcom gewonnen, um Training großer KI-Modelle zu beschleunigen.

Kurzfassung

Warum das wichtig ist

- Es ist das eine, mit einem oder zwei großen Namen im KI-Segment zusammenzuarbeiten; OpenAI hat jedoch AMD, NVIDIA, Intel, Microsoft Broadcom gewonnen, um Training großer KI-Modelle zu beschleunigen.

- Die neue Ankündigung für ein Supercomputer-Netzwerk, das darauf abzielt, das Training großer KI-Modelle zu beschleunigen.

- Zu diesem Zweck arbeiten AMD, Broadcom, Intel, Microsoft und NVIDIA mit dem Unternehmen zusammen, um ein neues Protokoll namens MRC (Multipath Reliable Connection) zu entwickeln, mit dem Ziel, die Netzwerkleistung und die Resilienz ßen Trainingsclustern zu verbessern.

Wir haben uns mit @AMD, @Broadcom, @Intel, @Microsoft und @NVIDIA verbündet, um Multipath Reliable Connection (MRC) zu veröffentlichen – ein neues offenes Netzwerkprotokoll, das große KI-Trainingsclustern hilft, schneller und zuverlässiger zu laufen und weniger GPU-Zeit zu verschwenden.

OpenAI hat MRC heute über das OCP (Open Compute Project) veröffentlicht, um die breitere Nutzung des Protokolls bei KI-Unternehmen zu ermöglichen. Das Problem, das die Einführung, ist der Datentransfer beim Training großer KI-Modelle. Es wird festgestellt, dass selbst ein einziger verspäteter Transfer den gesamten Prozess unterbrechen und dazu führen kann, dass GPUs ungenutzt bleiben.

Die Hauptursachen für diese Verzögerungen sind Netzwerkkongestion, Verbindungs- und Geräteausfälle. Je größer die Clustergröße ist, desto häufiger tritt dieses Problem auf. MRC ist der grundlegende Ansatz für nächste-Generation- und großskalige Supercomputer-Plattformen für KI.

Moegliche Anwendungen

OpenAI gibt an, dass es sich in den letzten zwei Jahren mit AMD, Broadcom, Intel, Microsoft und NVIDIA zusammengearbeitet hat, um das Protokoll zu entwickeln, das in den neuesten 800-Gbit/s-Netzwerkinterfaces integriert ist. Dies ermöglicht es KI-Unternehmen, einen einzelnen Transfer über Hunderte unterbrochener Pfade zu verteilen, Ausfälle in Mikrosekunden zu umgehen und einfachere Netzwerkkontroll-Ebenen zu betreiben.

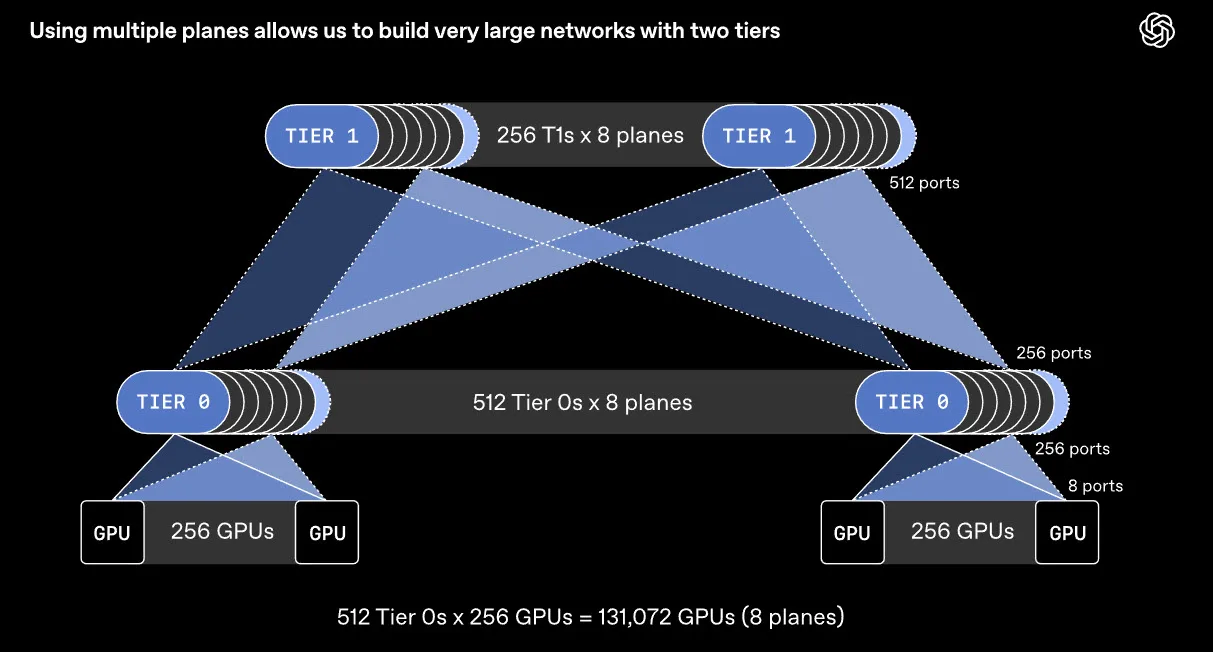

Statt jedes Netzwerkinterface als eine einzige 800-Gbit/s-Verbindung zu behandeln, wird diese in mehrere kleinere Links aufgeteilt. Beispielsweise kann ein Interface mit acht verschiedenen Switches verbunden werden. Sie knnen dann acht separate parallele Netzwerke, auch Ebenen genannt, aufbauen, die jeweils mit 100 Gb/s arbeiten, anstatt ein einzelnes 800 Gb/s-Netzwerk.

Diese nderung hat einen erheblichen Einfluss auf die Architektur des Clusters. Ein Switch, der 64 Ports mit 800 Gb/s verbinden kann, kann stattdessen 512 Ports mit 100 Gb/s anschlieen. Dies ermglicht es, ein vollstndig vernetztes Netzwerk 131.000 GPUs mit nur zwei Switch-Ebenen zu realisieren. Ein konventionelles 800 Gb/s-Netzwerk wrde hingegen drei oder vier Ebenen erfordern.

OpenAI Der MRC-Standard erweitert das bestehende

OpenAI Der MRC-Standard erweitert das bestehende RDMA over RoCE (Converged Ethernet). Dies ermglicht hardwarebeschleunigten Remote Direct Memory Access fr GPUs und CPUs. OpenAI hat MRC bereits in seinen Supercomputern eingesetzt, die NVIDIA GB200 Blackwell"-GPUs beherbergen, die fr das Training gehren die Oracle Cloud Infrastructure (OCI) in Abilene, Texas, sowie Microsofts Fairwater-Supercomputer.

Derzeit wird MRC bereits zum Training mehrerer OpenAI-Modelle auf Hardware. Das RCP-Protokoll wird für OpenAIs Supercomputer Stargate, der Abilene, Texas, errichtet wird. Der Supercomputer zielt darauf ab, bis 2029 eine KI-Berechnungsleistung von 10 GW bereitzustellen und hat in den vergangenen drei Monaten bereits mehr als 3 GW deployed.

Durch die Verfügbarkeit und Öffnung des RCP für die gesamte KI-Branche wird der Weg für eine sektorübergreifende Zusammenarbeit bei der Lösung der schwierigsten Probleme im Bereich KI geebnet und der Segment weiterentwickelt. Über den Autor: Hassan Mujtaba, ausgebildet als Softwareingenieur und leidenschaftlicher PC-Enthusiast, fungiert er als Senior Editor für den Hardware-Bereich bei Wccftech.

Mit jahrelanger Branchenerfahrung spezialisiert er sich auf tiefgehende technische Analysen nächsten Generation für CPUs und GPUs, Mainboards sowie Kühlsysteme. Seine Arbeit umfasst nicht nur die Berichterstattung über kommende Technologien, sondern auch umfangreiche praktische Reviews und Benchmarks. Sie Wccftech auf Google, um weitere unserer Nachrichtenabdeckungen in Ihren Feeds zu erhalten.

Quelllink

Wccftech - Originalartikel oeffnenThema weiterverfolgen

Interne Verlinkung

Im Kontext weiterlesen

Diese weiterfuehrenden Links verbinden das Thema mit relevanten Archivseiten, Schlagwoertern und inhaltlich nahen Artikeln.

Technologie Archiv

Weitere Meldungen aus derselben Hauptkategorie.

Mehr von Wccftech

Alle veroeffentlichten Inhalte derselben Quelle im Archiv.

EVE Online-Entwickler Fenris Creations: Nach Rekordjahr von 70 Millionen Dollar verlässt Studio Pearl Abyss und startet mit Google DeepMind als Investor neu

Redaktionell verwandter Beitrag aus dem selben Themenumfeld.

SpaceXAI investiert 220.000 NVIDIA-GPUs bei Anthropic und plant Orbital-Computing mit Multi-GW-Leistung

Redaktionell verwandter Beitrag aus dem selben Themenumfeld.

Quellenprofil

Quelle und redaktionelle Angaben

- Quelle

- Wccftech

- Originaltitel

- OpenAI Got The Whole AI Squad To Accelerate Large-Scale AI Training – AMD, NVIDIA, Intel, Microsoft & Broadcom All-In On MRC

- Canonical

- https://wccftech.com/openai-accelerates-large-scale-ai-training-amd-nvidia-intel-microsoft-broadcom-mrc/

- Quell-URL

- https://wccftech.com/openai-accelerates-large-scale-ai-training-amd-nvidia-intel-microsoft-broadcom-mrc/

Aehnliche Inhalte

Verwandte Themen und interne Verlinkung

Weitere Artikel aus aehnlichen Themenfeldern, damit Leser direkt im selben Kontext weiterlesen koennen.

EVE Online-Entwickler Fenris Creations: Nach Rekordjahr von 70 Millionen Dollar verlässt Studio Pearl Abyss und startet mit Google DeepMind als Investor neu

Nach Verkauf Abyss für 120 Millionen US-Dollar in bar und Form nicht-barer Vermögenswerte kündigte das isländische Studio, das vor allem für das MMORPG Online bekannt ist, an, sich neu

06.05.2026

Live RedaktionSpaceXAI investiert 220.000 NVIDIA-GPUs bei Anthropic und plant Orbital-Computing mit Multi-GW-Leistung

SpaceXAI hat angekündigt, Anthropic Zugang zu seinem Supercomputer Colossus 1 mit 220.000 NVIDIA-GPUs zu gewähren, und plant zudem Orbital-Compute-Cluster.

06.05.2026

Live RedaktionMicrosoft beauftragt Studie: Windows 11-Laptop mit 56 % längerer Akkulaufzeit schlägt MacBook Neo

Das neue MacBook eher zufriedenen Welt der Windows 11 basierenden Laptops ausgelöst zu haben, sodass Microsoft nun apparently Drittanbieterorganisationen bezahl

06.05.2026

Live Redaktion

Nintendo-Aktie auf längstem Verlustkurs seit 2016: Anleger fordern Preiserhöhung für Switch 2 trotz Pokopia und Mario Galaxy

Sony hat dies über sein gesamtes PlayStation-Ökosystem hinweg getan (PS5, PS5 Slim, PS5 Pro PlayStation Portal).

06.05.2026

Live Redaktion