Meta setzt auf Amazons 3nm Graviton-Chips für die nächste KI-Welle

Meta hat einen Vertrag über Bereitstellung Zehn Millionen Graviton-Prozorkernen unterzeichnet, während Unternehmen Rechen-Rückgrat für seine nächste Generation von künstlicher Intelligenzsystemen erwe

Kurzfassung

Warum das wichtig ist

- Meta hat einen Vertrag über Bereitstellung Zehn Millionen Graviton-Prozorkernen unterzeichnet, während Unternehmen Rechen-Rückgrat für seine nächste Generation von künstlicher Intelligenzsystemen erwe

- Die Vereinbarung vertieft die langjährige Beziehung von Meta zu Amazon Web Services und unterstreicht einen wachsenden Wandel in der KI-Infrastruktur.

- Während Grafikprozessoren für das Training großer KI-Modelle weiterhin zentral sind, suchen Unternehmen nun verstärkt nach CPU-Leistung für Inferenz, Echtzeit-Schlussfolgerungen, Suche, Codierungswerkzeuge und mehrstufige KI-Agenten.

Meta hat einen Vertrag über die Bereitstellung von Zehn Millionen AWS Graviton-Prozorkernen unterzeichnet, während das Unternehmen das Rechen-Rückgrat für seine nächste Generation von künstlicher Intelligenzsystemen erwe Meta hat einen Vertrag über die Bereitstellung von Zehn Millionen AWS Graviton-Prozorkernen unterzeichnet, während das Unternehmen das Rechen-Rückgrat für seine nächste Generation von künstlicher Intelligenzsystemen erweitert.

Die Vereinbarung vertieft die langjährige Beziehung von Meta zu Amazon Web Services und unterstreicht einen wachsenden Wandel in der KI-Infrastruktur.

Während Grafikprozessoren für das Training großer KI-Modelle weiterhin zentral sind, suchen Unternehmen nun verstärkt nach CPU-Leistung für Inferenz, Echtzeit-Schlussfolgerungen, Suche, Codierungswerkzeuge und mehrstufige KI-Agenten.

Amazon sagte, dass die Einführung

Amazon sagte, dass die Einführung mit Zehn Millionen Graviton-Kernen beginnen und bei steigender KI-Nachfrage von Meta weiter ausgebaut werden kann. Es wird erwartet, dass die Chips eine Reihe von Meta-Workloads mit KI-Diensten antreiben, die von Milliarden von Menschen über seine Plattformen genutzt werden.

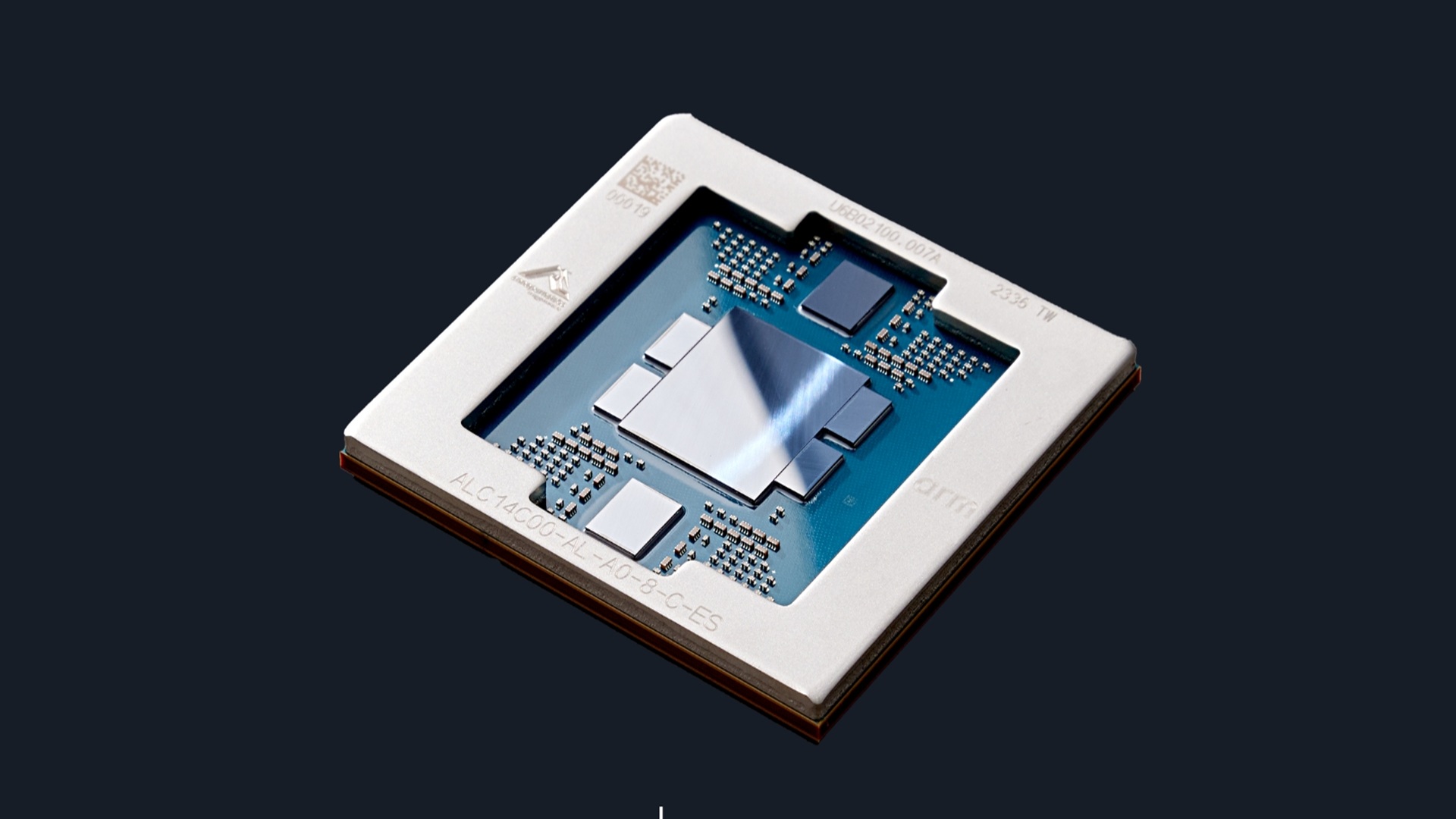

Der Schritt spiegelt auch die steigende Nachfrage nach kundenspezifischem Silizium wider, das Kosten und Energieverbrauch senken und gleichzeitig Leistung im Hyperscale-Bereich liefern kann. CPU-Wettlauf beginnt AWS Graviton-Chips sind die intern entwickelten Prozessoren von Amazon, die auf der Arm-Architektur basieren.

Sie sind darauf ausgelegt, Cloud-Workloads schneller, günstiger und mit geringerem Stromverbrauch zu betreiben als viele herkömmliche Server-Chips. Der neueste Graviton5-Chip verwendet ein 3-Nanometer-Fertigungsprozess und verfügt über 192 Kerne.

Leistung und Energieausbeute

Amazon sagte, er biete bis zu 25 Prozent bessere Leistung als die vorherige Generation. Das Unternehmen gab auch bekannt, dass Graviton5 einen Cache mit fünfmal größerer Kapazität als die vorherige Version besitzt, was hilft, Verzögerungen bei der Kommunikation zwischen den Kernen um bis zu 33 Prozent zu reduzieren.

Das ist wichtig für KI-Systeme, die Daten schnell verarbeiten und gleichzeitig viele Aufgaben koordinieren müssen. Graviton-Prozessoren laufen auf dem AWS Nitro System, Amazons Hardware- und Software-Stack, der entwickelt wurde, um Sicherheit, Networking und Leistung zu verbessern.

Die Chips unterstützen auch die Elastic Fabric Adapter Technologie, die eine Kommunikation mit geringer Latenz über große Server-Cluster ermöglicht. Nachfrage nach KI verschiebt sich Während sich KI-Produkte weiterentwickeln, bewegt sich die Branche über das reine Modelltraining hinaus.

Neuere agentische KI-Systeme sollen Planung, Codierung,

Neuere agentische KI-Systeme sollen Planung, Codierung, Schlussfolgerung und Ausführung von Aufgaben in Echtzeit bewältigen und damit eine hohe Nachfrage nach CPUs neben GPUs erzeugen.

„Hier geht es nicht nur um Chips; es geht darum, Kunden die infrastrukturelle Grundlage sowie Daten- und Inferenzdienste zu geben, um KI zu entwickeln, die versteht, antizipiert und effizient auf Milliarden von Menschen weltweit skaliert“, sagte Nafea Bshara, Vice President und Distinguished Engineer bei Amazon.

„Die erweiterte Partnerschaft von Meta, die den Einsatz von Zehnern von Millionen Graviton-Kernen beinhaltet, zeigt, was passiert, wenn man speziell entwickelten Silizium mit dem vollständigen AWS AI Stack kombiniert, um die nächste Generation agentischer KI zu betreiben.“ Meta sagte, dass die Erweiterung der Rechenquellen nun eine strategische Priorität sei, während es seine KI-Operationen skaliert.

Leistung und Energieausbeute

„Während wir die Infrastruktur hinter Metas KI-Ambitionen skalieren, ist die Diversifizierung unserer Rechenquellen ein strategisches Gebot.“ „AWS ist seit Jahren ein vertrauenswürdiger Cloud-Partner, und die Erweiterung auf Graviton ermöglicht es uns, die rechenintensiven Workloads hinter agentischer KI mit der Leistung und Effizienz auszuführen, die wir in unserem Umfang benötigen“, sagte Santosh Janardhan, Leiter der Infrastruktur bei Meta.

Der Deal unterstreicht auch, wie die Energieeffizienz bei KI-Ausbauten zu einem immer größeren Faktor wird. Da die Nachfrage nach Rechenleistung steigt, kann die Chip-Effizienz die Betriebskosten, die Stromverfügbarkeit und die Nachhaltigkeitsziele direkt beeinflussen.

Für Amazon bietet die Vereinbarung Graviton eine seiner größten öffentlichen Bestätigungen bisher. Für Meta eröffnet sie einen weiteren Weg, die KI-Infrastruktur über traditionelle Prozessoranbieter hinaus zu skalieren.

Thema weiterverfolgen

Quellenprofil

Quelle und redaktionelle Angaben

- Quelle

- Interesting Engineering

- Originaltitel

- Meta picks Amazon's 3nm Graviton chips to power next AI wave

- Canonical

- https://interestingengineering.com/ai-robotics/meta-deploys-amazon-graviton-chips-ai-infrastructure

- Quell-URL

- https://interestingengineering.com/ai-robotics/meta-deploys-amazon-graviton-chips-ai-infrastructure

Aehnliche Inhalte

Verwandte Themen und interne Verlinkung

Weitere Artikel aus aehnlichen Themenfeldern, damit Leser direkt im selben Kontext weiterlesen koennen.

Wissenschaftler detektieren direkt eines der seltensten Argon-Isotope der Erde

In einer Welt, die Billionen Billionen Atomen gefüllt ist, erscheint es fast unmöglich, eine Handvoll zu entdecken, die kaum existieren.

27.04.2026

Live Redaktion

Hacker können die Entra Agent ID Administrator-Rolle missbrauchen, um Dienstprinzipale zu übernehmen

Eine kritische Überdehnungs-Schwachstelle wurde kürzlich in Microsoft Entra Agent Identity Platform identifiziert.

27.04.2026

Live Redaktion

US-Bunker-Buster-Sprengkopf wird von Drohne abgeworfen und zerstört Ziel

Die Vereinigten Staaten haben ihre Fähigkeit getestet, einen Bunker-Buster-Munition Drohnen auszuliefern.

27.04.2026

Live Redaktion

ADT bestätigt Datenleck nach Behauptung von ShinyHunters über Datenabfluss

Der Sicherheitsriese für Zuhause, Inc., hat eine Datenpanne bestätigt, nachdem die berüchtigte Bedrohungsgruppe ShinyHunters behauptet hatte, über 10 Millionen Datensätze gestohlen und ein Lösegeldforderungsultimatum

27.04.2026

Live Redaktion