DeepSeek enthüllt V4 KI mit 1-Million-Kontextfenster und zielt auf US-Konkurrenten ab

Das Rennen um künstliche Intelligenz beschleunigt sich. OpenAI hat diese Woche GPT-5.5 veröffentlicht, während Weiße Haus China beschuldigte, US-KI-Systeme in großem Maßstab zu kopieren.

Kurzfassung

Warum das wichtig ist

- OpenAI hat diese Woche GPT-5.5 veröffentlicht, während Weiße Haus China beschuldigte, US-KI-Systeme in großem Maßstab zu kopieren.

- Nun hat DeepSeek Vorschauvers Das Rennen um künstliche Intelligenz beschleunigt sich.

- Nun hat DeepSeek Vorschauversionen seines V4-Modells eingeführt, die einen direkten Wettbewerb mit den führenden US-Plattformen anstreben.

Das Rennen um künstliche Intelligenz beschleunigt sich. OpenAI hat diese Woche GPT-5.5 veröffentlicht, während das Weiße Haus China beschuldigte, US-KI-Systeme in großem Maßstab zu kopieren.

Nun hat DeepSeek Vorschauvers Das Rennen um künstliche Intelligenz beschleunigt sich. OpenAI hat diese Woche GPT-5.5 veröffentlicht, während das Weiße Haus China beschuldigte, US-KI-Systeme in großem Maßstab zu kopieren.

Nun hat DeepSeek Vorschauversionen seines V4-Modells eingeführt, die einen direkten Wettbewerb mit den führenden US-Plattformen anstreben. DeepSeek veröffentlichte die V4 Flash und V4 Pro Serie und hob Gewinne bei der Codierung, im Schlussfolgern und bei agentengetriebenen Aufgaben hervor.

Die Modelle beinhalten architektonische Upgrades

Die Modelle beinhalten architektonische Upgrades und Optimierungsverbesserungen mit einem klaren Fokus auf Effizienz, da die Systeme im Betrieb immer teurer werden. Ein Schlüsselfunktionalität ist das, was DeepSeek die Hybrid Attention Architecture nennt.

Die Methode verbessert, wie Modelle Kontext über lange Gespräche hinweg beibehalten, und reduziert den Speicherverlust bei ausgedehnten Interaktionen. Das System unterstützt außerdem ein Kontextfenster von 1 Million Tokens und ermöglicht es den Benutzern, ganze Codebasen oder lange Dokumente in einem einzigen Prompt einzugeben.

Dies könnte die Arbeitsabläufe in der Softwareentwicklung und der Unternehmensanalyse neu gestalten. DeepSeek meldete eine starke Benchmark-Leistung im Vergleich zu Systemen von Anthropic, Google und OpenAI.

Allerdings räumte das Unternehmen ein,

Allerdings räumte das Unternehmen ein, dass V4 immer noch drei bis sechs Monate hinter den fortschrittlichsten Modellen liegt, betonte jedoch die Kosten und die Bereitstellungsflexibilität. Kosten- und Chipstrategie DeepSeek setzt weiterhin auf Effizienz als Wettbewerbsvorteil.

Sein Billionen-Parameter-System nutzt einen Mixture-of-Experts-Ansatz und aktiviert für jede Aufgabe nur einen Bruchteil der Parameter. Dies reduziert die Inferenzkosten im Vergleich zu traditionellen Modellen, die typischerweise für jede Anfrage alle Parameter aktivieren.

Die Modelle sind auch darauf ausgelegt, auf heimischer Hardware zu laufen. DeepSeek erwartet, dass die Kosten sinken werden, sobald später in diesem Jahr Cluster mit den Ascend 950 Chips von Huawei Technologies Co. betriebsbereit sind.

Dieser Wandel könnte die Abhängigkeit

Dieser Wandel könnte die Abhängigkeit von US-Chipherstellern verringern und Chinas KI-Infrastruktur stärken. Die Märkte reagierten schnell.

Die Aktien von Semiconductor Manufacturing International Corp. und Hua Hong Semiconductor stiegen, während rivalisierende KI-Firmen fielen. Anleger scheinen auf eine erhöhte Nachfrage nach chinesisch hergestellten Chips zu wetten.

DeepSeek sagte, dass die Servicekapazität für die V4 Pro Serie aufgrund begrenzter Rechenressourcen weiterhin eingeschränkt sei. Das Unternehmen befindet sich außerdem in Gesprächen mit Tencent Holdings Ltd. und Alibaba Group Holding Ltd. über seine erste Finanzierungsrunde, was Pläne zur Erweiterung der Infrastruktur signalisiert.

Leistung und Energieausbeute

Druck auf US-Konkurrenten Der V4-Start folgt auf das frühere R1-Modell, das den KI-Markt erschütterte und zu einer Neubewertung der Ausgaben für Frontier-Systeme führte. DeepSeek behauptete, R1 habe eine wettbewerbsfähige Leistung bei einem Bruchteil der Kosten führender US-Modelle erbracht.

Diese Debatte hat sich seitdem erneut verschoben. Es wird prognostiziert, dass US-Tech-Firmen im Jahr 2026 rund 650 Milliarden US-Dollar in KI-Infrastruktur und Rechenzentren investieren und so Leistungssteigerungen mit langfristigen Kosten abwägen.

DeepSeek sagte, V4 baue auf diesem Ansatz auf, indem es sowohl die Skalierung als auch die Effizienz verbessert. Es positioniert weiterhin Open-Source-Modelle als Alternativen zu geschlossenen Systemen und spricht Entwickler und Unternehmen an, die mehr Kontrolle suchen.

Dennoch steht die Veröffentlichung unter Beobachtung.

Dennoch steht die Veröffentlichung unter Beobachtung. US-Beamte haben DeepSeek beschuldigt, eingeschränkte Chips zu verwenden, während Anthropic von Missbrauch seines Claude-Systems berichtet hat.

DeepSeek hat die Trainingskosten oder Hardware-Details für V4 nicht offengelegt. Der Start unterstreicht den intensivierenden globalen Wettbewerb.

Durch den Fokus auf niedrigere Kosten, skalierbare Leistung und Hardware-Flexibilität fordert DeepSeek heraus, wie KI-Systeme aufgebaut werden und wer die nächste Entwicklungsphase anführt.

Thema weiterverfolgen

Quellenprofil

Quelle und redaktionelle Angaben

- Quelle

- Interesting Engineering

- Originaltitel

- DeepSeek unveils V4 AI with 1M context window, targets US rivals

- Canonical

- https://interestingengineering.com/ai-robotics/deepseek-v4-ai-model-long-context-cost-efficiency

- Quell-URL

- https://interestingengineering.com/ai-robotics/deepseek-v4-ai-model-long-context-cost-efficiency

Aehnliche Inhalte

Verwandte Themen und interne Verlinkung

Weitere Artikel aus aehnlichen Themenfeldern, damit Leser direkt im selben Kontext weiterlesen koennen.

Einige Marken sind von dem US-Router-Verbot ausgenommen, aber niemand weiß, warum

Zwei Wochen nach Entscheidung gaben die FCC und Homeland Security Bureau am 14.

26.04.2026

Live Redaktion

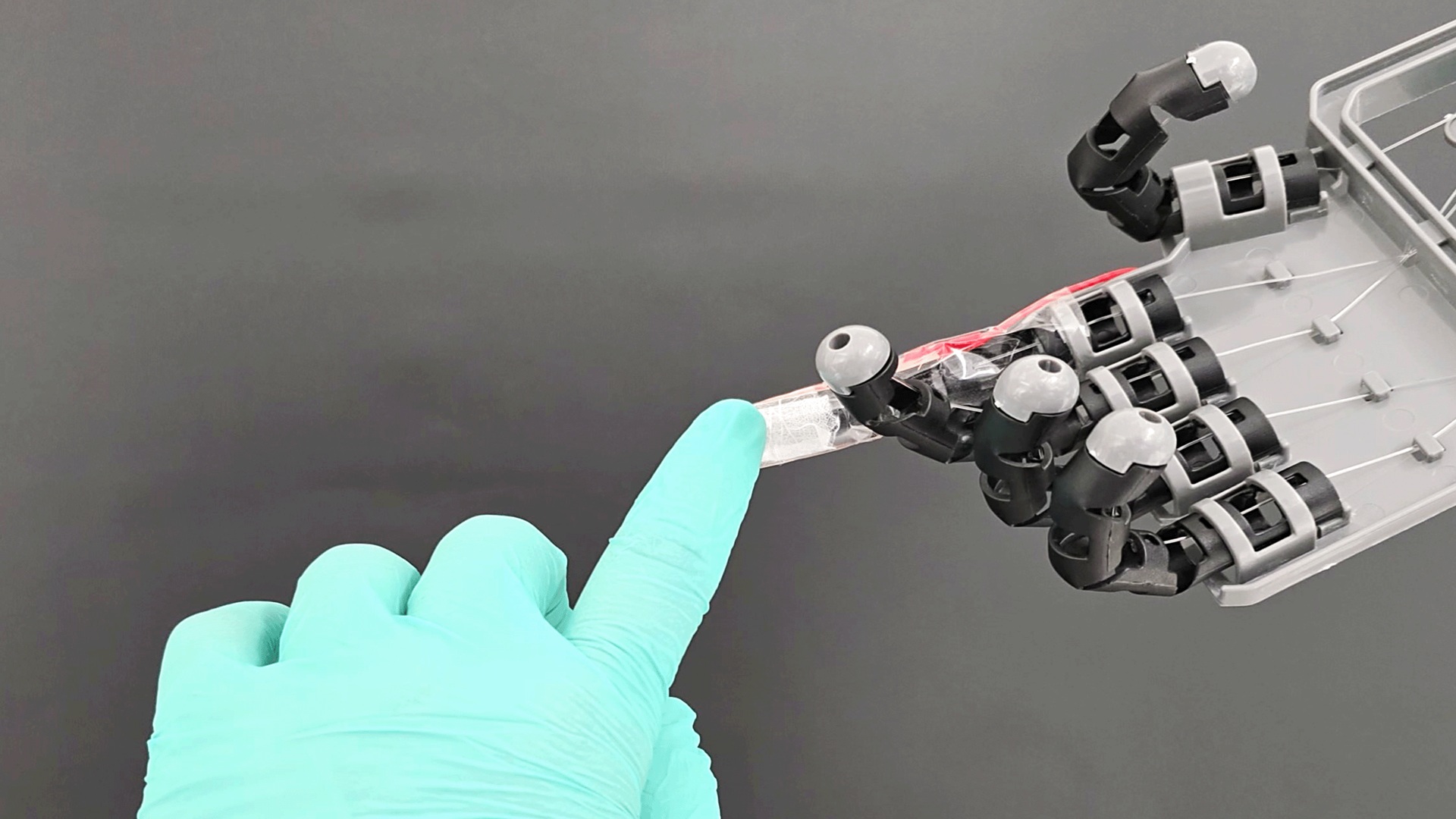

Neue E-Haut verleiht Roboterhand taktiles Gefühl in bahnbrechendem Test

Dehnbare, transparente Elektronik, die sich biegen, rollen und sogar menschliche Haut imitieren kann, rückt näher an den realen Einsatz.

26.04.2026

Live Redaktion

Claude soll die Browser-Zugriffsschnittstelle für mehrere Chromium-basierte Browser hinzufügen

Ein kürzlich durchgeführter technischer Audit Datenschutzforscher Alexander Hanff hat aufgedeckt, dass Claude Desktop-Anwendung Anthropic für macOS ohne Benachrichtigung einen Native Messaging Bridge in die

26.04.2026

Live Redaktion

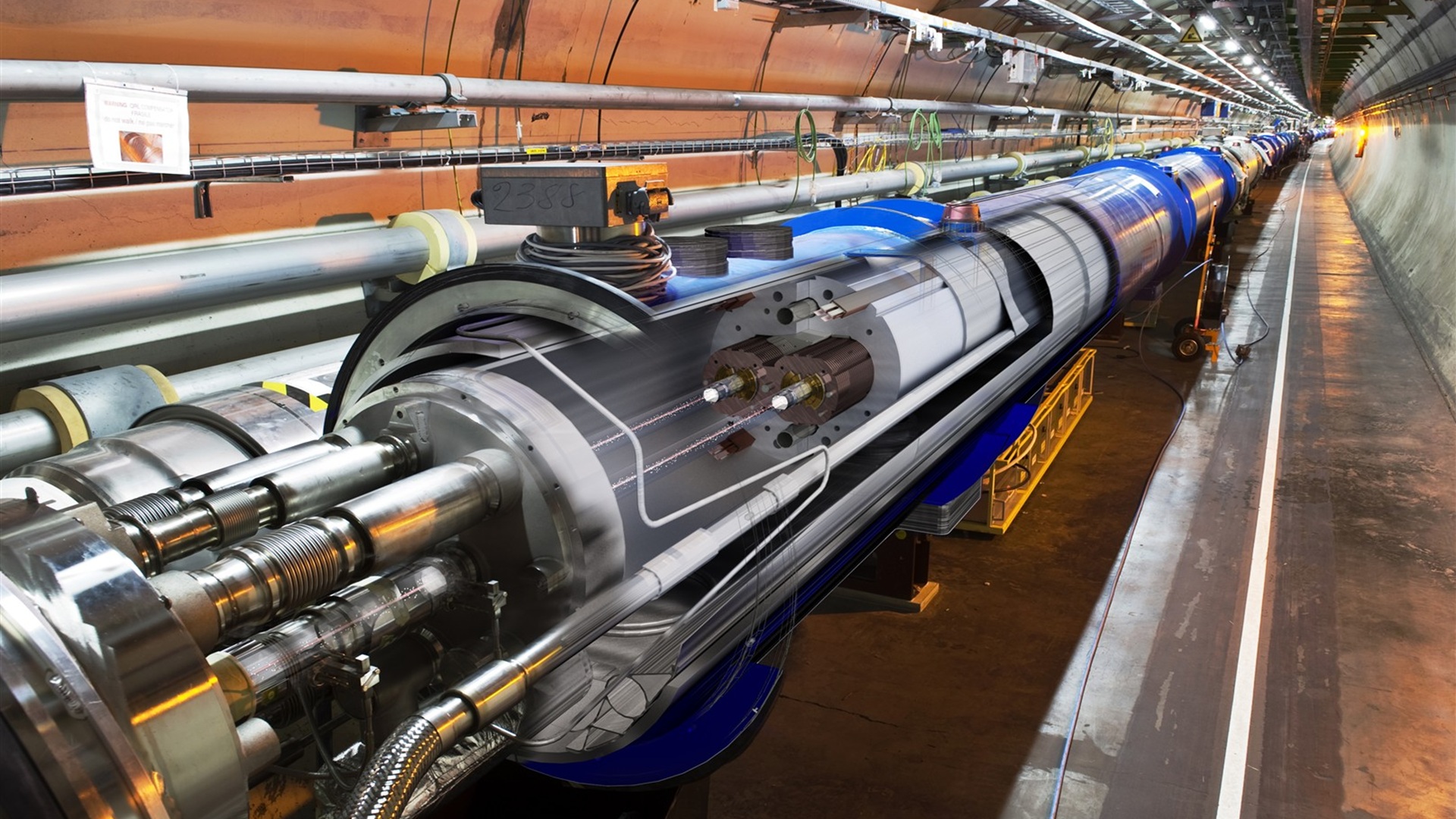

CERN versetzt 312 Fuß langen HiLumi LHC Teststand in Betrieb nach Kühlung auf -456°F

Wissenschaftler am CERN haben einen großen Erfolg erzielt, nachdem sie mit Stromversorgung eines 312 Fuß langen Teststands für High-Luminosity LHC (HL-LHC) Upgrade begonnen haben, nur wenige Wochen nachdem sie

26.04.2026

Live Redaktion